Практическое руководство по самому мощному тренингу стратегии обработки данных.

Восемь лет назад наука о данных была объявлена «самой сексуальной работой 21 века». Тем не менее, тратить несколько часов на обработку данных по-прежнему кажется абсолютно немыслимым. Во всяком случае, легендарное развитие области data science продемонстрировало, насколько плохо большинство организаций справляются с управлением своими данными.

Найдите в поисковике Certified Data Management Professional (CDMP) от Data Management Association International (DAMA). CDMP — лучшая сертификация стратегии обработки данных, о которой вы ранее не слышали. (Ведь если учесть тот факт, что у вас, вероятно, профессия, которой не было десять лет назад, неудивительно, что эта сертификация пока еще не получила широкого распространения).

Стратегия обработки данных — чрезвычайно важная дисциплина, охватывающая непрерывное управление жизненным циклом данных, а также связанные с этим аспекты управления данными и ключевые аспекты этики данных.

В этой статье рассказывается, как и зачем получать CDMP, который закладывает основу для эффективного интеллектуального лидерства в стратегии данных.

В этом руководстве:

1. Об экзамене CDMP;

2. Как подготовиться к CDMP;

3. Что проверяется на экзамене CDMP;

4. Почему специалисты по данным должны пройти сертификацию CDMP.

Об экзамене CDMP

Подготовка к CDMP предполагает знание и умение работать в 14 областях, связанных со стратегией данных (о которых расскажем более подробно в следующих разделах). Данный тест является экзаменом типа «Открытая книга», но 100 вопросов на экзамене должны быть выполнены в течение 90 минут. Следовательно, важно хорошо ознакомиться со справочными материалами.

Когда вы планируете экзамен ($300), DAMA предоставляет 40 практических вопросов, которые отражают сложность фактического экзамена. В качестве дополнительного ресурса ознакомьтесь с этой статьей о процессе подготовки к сертификации.

Можно сдать экзамен онлайн под наблюдением через веб-камеру (оплата $11). Формат экзамена — выбор верного ответа: либо из 5 вариантов, либо T/F. Также есть возможность вернуться к предыдущим вопросам. По завершении теста вы сразу же получаете вашу оценку.

Все, что выше 60%, означает, что экзамен сдан. 60% — это хороший результат, если вы хотите просто пройти сертификацию и двигаться дальше. Если вас интересуют продвинутые уровни CDMP, то это 70% (специалист CDMP) или 80% (мастер CDMP). Чтобы получить сертификат высшего уровня, член CDMP, вам необходимо пройти тест на 80%, а также продемонстрировать отраслевой опыт и вклад в эту область. Каждый из продвинутых уровней требует сдачи двух специальных экзаменов.

Это подводит нас к заключительному пункту, который касается того, ЗАЧЕМ получать CDMP — исключительно с точки зрения карьерного роста — вы должны пройти через подготовку и сдачу экзамена: сертификация от DAMA связана с высокими должностями в руководстве, управлении и архитектуре данных. Все чаще требования о сертификации CDMP предъявляются к предприятиям и федеральным контрактам, связанным с управлением данными.

Преимущества:

- Создание прочной базы знаний по темам, связанным со стратегией данных;

- Тест типа «Открытая книга» предполагает меньше временных затрат на зубрежку;

- Четыре различных уровня для специалистов по управлению данными;

- Порог прохождения сертификации — 60%;

- Предоставление членства в DAMA International на 3 года;

- Стоимость экзамена в размере $311 дешевле, чем другие сертификаты, связанные с данными, от Microsoft и Open Group.

Недостатки:

- DAMA не поддерживается крупными технологическими компаниями (например, Amazon, Google, Microsoft), которые активно стимулируют продвижение в маркетинге и способствует узнаваемости бренда сертификации CDMP — это означает, что CDMP, вероятно, будет признан ценным в основном среди людей, которые уже знакомы с управлением данными.

- Стоимость за экзамен $311 относительно высока, по сравнению с сертификатом AWS Cloud Practitioner cert ($100) или GPC certs ($200).

Альтернативы:

Microsoft Certified Solutions Associate (MCSA) — модульная сертификация, ориентированная на различные продукты Microsoft ($330+);

Microsoft Certified Solutions Expert (MCSE) — основан на MCSA с интегрированными сертификатами по таким темам, как базовая инфраструктура, управление данными & аналитика, а также производительность ($495+);

The Open Group Architecture Framework (TOGAF) — различные уровни сертификации по системе высокого уровня для разработки программного обеспечения и методологии корпоративной архитектуры ($550+);

Scaled Agile Framework (SAFe) — сертификаты для разработчиков программного обеспечения ($995);

Как подготовиться к CDMP

Учитывая, что CDMP — тест типа «Открытая книга», для подготовки к экзамену все, что нужно, — это книга DAMA Body of Knowledge (DMBOK $ 55). Это около 600 страниц, но если вы сосредоточите свое внимание, главным образом, на главе 1 (Управление данными), диаграммах и схемах, ролях, обязанностях и определениях, то это должно дать вам 80% успеха на пути к проходному баллу.

Что касается того, как правильно использовать DMBOK, один участник тестирования рекомендовал 4–6 часов в выходные в течение 8–10 недель. Другой подход — читать по паре страниц каждое утро и вечер. В любом случае, обязательно включайте интервальные повторения в свою методику обучения.

DMBOK является не только вашим учебным пособием для экзамена, но и полезен в качестве справочника. Вы можете посоветовать его своему коллеге, если ему нужно изучить стратегию обработки данных, или кинуть книгу ему на стол, если он задремал во время вебинара =)

Что проверяется на экзамене CDMP

CDMP охватывает 14 тем — перечислены ниже в порядке распространенности, с которой они встречаются на экзамене, с кратким определением каждой из них.

Управление данными (11%) — методы и процессы обеспечения официального управления данными;

Качество данных (11%) — обеспечение пригодности данных для использования благодаря их точности, полноты, последовательности, целостности, разумности, своевременности, уникальности/дедупликации, достоверности и доступности;

Моделирование и проектирование данных (11%) — перевод бизнес-потребностей в технические характеристики;

Управление метаданными (11%) — информация о собранных данных;

Управление основными и справочными данными (10%) — справочные данные — это информация, используемая для классификации других данных, содержащихся в базе данных, или информация, которая предназначена исключительно для соотнесения данных в базе данных с информацией за пределами организации. Основные справочные данные относятся к информации, которая используется в нескольких системах внутри организации.

Хранилище данных и бизнес-аналитика (10%) — хранилище данных хранит информацию из операционных систем (а также, возможно, из других ресурсов данных) таким образом, чтобы она была оптимизирована для поддержки процессов принятия решений. Под бизнес-аналитикой понимается использование технологий для сбора и анализа данных, а затем их преобразования в полезную информацию.

Управление документацией и контентом (6%) — технологии, методы и инструменты, используемые для организации и хранения документов организации.

Интеграция и взаимодействие данных (6%) — использование технических и бизнес-процессов для объединения данных из разных источников с целью быстрого и эффективного предоставления доступа к ценной информации.

Архитектура данных (6%) — спецификации для описания существующего состояния, определения требований к данным, управления интеграцией данных и контроля активов данных в соответствии со стратегией данных организации.

Безопасность данных (6%) — реализация политики и процедур, обеспечивающих правильные действия людей и объектов с данными и информационными активами даже при наличии злонамеренных входов.

Хранение данных и операции (6%) — характеристика оборудования или программного обеспечения, которое хранит, удаляет, выполняет резервное копирование, систематизирует и защищает информацию организации.

Процесс управления данными (2%) — сквозное управление данными, включая сбор, контроль, защиту, предоставление и улучшение.

Большие данные (2%) — чрезвычайно большие наборы данных, часто состоящие из различных структурированных, неструктурированных и полуструктурированных типов данных.

Этика данных (2%) — кодекс поведения, охватывающий обработку данных, алгоритмы и другие методы обеспечения надлежащего использования данных в моральном контексте.

Почему специалисты по данным должны пройти сертификацию CDMP

Все еще не уверены, почему важна стратегия данных? Давайте посмотрим с точки зрения специалиста по данным, стремящегося расширить свои знания и потенциал заработка.

Говорят, что специалист по данным находится на стыке статистики, информатики и предметных знаний. Так зачем в это блюдо добавлять что-то еще?

Для успеха лучше владеть хорошо двумя взаимодополняющими навыками, чем только одним, но отлично.

Скотт Адамс, автор и создатель комиксов Дилберта, предлагает идею, что «каждое приобретенное умение удваивает шансы на успех.» Он признает, что это может быть несколько преувеличением — «очевидно, что некоторые навыки более ценны, чем другие, и двенадцатое умение, которое вы приобретаете, может иметь меньшую ценность, чем каждое из первых одиннадцати», — но дело в том, что иногда лучше идти шире, чем углубляться.

Если оставить в стороне относительную величину выгоды, то несомненно, что расширение вашего набора навыков может привести к более значительным успехам, по сравнению с упорным трудом над улучшением одного конкретного навыка. В двух словах, вот почему я считаю важным для data scientist’а изучить стратегию данных.

В целом, разнообразие ваших навыков позволяет вам:

1. Более эффективно решать проблемы, опираясь на междисциплинарные знания;

2. Общаться лучше с вашими товарищами по команде из других специальностей;

3. Открывать ворота в новые проекты.

Понимание стратегии данных превращает вас из потребителя данных в уполномоченного защитника данных в вашей организации.

Источник

1.3.1 НАЗНАЧЕНИЕ СВОДА ЗНАНИЙ

Ряд концептуальных понятий в области управления данными мы приводим на основании наиболее известного, полного и всеобъемлющего свода знаний в области управления данными — DAMA-DMBOK. Этот документ создан Международной ассоциацией управления данными (Data Management Association International, DAMA), которая объединяет профессионалов в области управления данными.

Сегодня существует только два полноценных комплекта справочных материалов по управлению данными, которые не зависят от поставщика соответствующих решений: DAMA-DMBOK и CMMI DMM (модель зрелости управления данными Института CMMI), см.: Aiken P., Harbour T. Data Strategy and the Enterprise Data Executive: Ensuring that Business and IT are in Synch in the Post-Big Data Era. Technics Publications, 2017.

Первое издание «Руководства DAMA к своду знаний по управлению данными» (Data Management Body of Knowledge, DMBOK) вышло в 2009 году. Эта книга заложила фундамент развития профессий, относящихся к управлению данными. В 2017 году опубликовано второе издание — DAMA-DMBOK2, а в 2020 году — его русский перевод.

Задачи DAMA — собирать, систематизировать и пропагандировать лучший опыт, вырабатывать единую терминологию и фреймворки для знаний и подходов. Основное назначение DMBOK — предоставление полного, точного и актуального введения в дисциплину управления данными,

в частности:

- выработка общепринятого согласованного представления об областях знаний по управлению данными;

- определение руководящих принципов управления данными;

- предоставление стандартных определений для наиболее часто используемых понятий (общих и по областям знаний);

- обзор лучших практик, методов и методик, а также альтернативных подходов;

- краткий обзор общих организационных и культурных вопросов;

- уточнение границ сферы управления данными;

- предоставление полезных общеупотребительных фреймворков управления данными (см. разделы 4.2, 4.3).

В DMBOK области знаний по управлению данными иногда также называются функциями управления данными.

Зачем DMBOK нужен «простому управленцу» или «простому госслужащему»? Подобные своды знаний есть и для других областей — от управления проектами (PMBOK) до бизнес-анализа и программной инженерии (BABOK и SWEBOK соответственно). Они полезны тем, что в концентрированной форме излагают основные идеи и принципы конкретной области, позволяя погрузиться в нее быстро и довольно глубоко. Конечно, максимум пользы из таких сводов знаний могут извлечь специалисты, имеющие опыт практической работы, но и начинающим они дают ясную картину предметной области. Мы не только рекомендуем ознакомиться с DAMA-DMBOK, но и даем в навигаторе ряд понятий в соответствии с этой методологией.

Зачем DMBOK нужен «простому управленцу» или «простому госслужащему»? Подобные своды знаний есть и для других областей — от управления проектами (PMBOK) до бизнес-анализа и программной инженерии (BABOK и SWEBOK соответственно). Они полезны тем, что в концентрированной форме излагают основные идеи и принципы конкретной области, позволяя погрузиться в нее быстро и довольно глубоко. Конечно, максимум пользы из таких сводов знаний могут извлечь специалисты, имеющие опыт практической работы, но и начинающим они дают ясную картину предметной области. Мы не только рекомендуем ознакомиться с DAMA-DMBOK, но и даем в навигаторе ряд понятий в соответствии с этой методологией.

Project Management Body of Knowledge («Свод знаний по управлению проектами»).

Business Analysis Body of Knowledge («Свод знаний по бизнес-аналитике»).

Software Engineering Body of Knowledge («Свод знаний по программной инженерии»).

1.3.2 ОДИННАДЦАТЬ ОБЛАСТЕЙ ЗНАНИЙ

Управление данными согласно DAMA-DMBOK строится вокруг основного фреймворка DAMA, включающего колесо DAMA, шестиугольник факторов среды и контекстные диаграммы. На рис. 6 представлено колесо DAMA — диаграмма областей знаний по управлению данными.

В русском переводе DAMA-DMBOK термину framework соответствует термин «рамочная структура»; в этой книге ради согласованности с другими главами (в частности, с главой 7) был выбран термин «фреймворк».

Рисунок 6

Колесо DAMA: области знаний по управлению данными

В DMBOK выделено 11 областей знаний по управлению данными.

1. Руководство данными (Data Governance) обеспечивает стратегическое управление информационными активами организации. Это одна из функций управления данными, главная по отношению ко всем другим его функциям. Руководство данными необходимо, чтобы обеспечить такие процессы принятия решений по поводу данных, которые отвечают интересам организации.

2. Архитектура данных задает схему управления информационными активами в соответствии со стратегией организации, формулируя стратегические требования к данным и способы удовлетворения этих требований.

3. Моделирование и проектирование данных — это процесс выявления, анализа, фиксации и распространения требований к данным в точно определенной форме, называемой моделью данных. Процесс происходит итеративно и может включать разработку концептуальной, логической и физической моделей.

4. Хранение данных и операции с ними. Проектирование и внедрение решений для хранения данных с целью максимального увеличения их ценности. Операции обеспечивают сопровождение данных на протяжении всего их жизненного цикла от планирования до удаления.

5. Безопасность данных обеспечивает приватность и конфиденциальность данных, защиту от взлома, надлежащий доступ к ним.

6. Интеграция и интероперабельность данных включают процессы, связанные с перемещением и консолидацией данных как внутри хранилищ, приложений и организаций, так и между ними.

7. Управление документами и контентом включает планирование, внедрение и мониторинг процессов, которые связаны с управлением ЖЦ данных (подробнее см. главу 2), полученных из разнообразных неструктурированных источников, особенно документов, которые необходимы для обеспечения выполнения нормативных требований.

8. Справочные данные и основные данные (мастер-данные) включают непрерывную сверку и согласование основных совместно используемых данных с целью обеспечить последовательное использование во всех системах наиболее точных, актуальных и релевантных сведений о ключевых бизнес-единицах.

9. Ведение хранилищ данных и бизнес-аналитика предполагают планирование, внедрение и контроль процессов управления теми данными, на основе которых принимаются решения, и создание условий, в которых информационные работники (knowledge workers) смогут извлекать ценность из данных с помощью их анализа и формирования отчетности.

10. Метаданные предполагают планирование, проведение и контроль работ по обеспечению доступа к интегрированным метаданным высокого качества, в том числе к определениям, моделям, потокам данных и другой информации, критически важной для понимания самих данных и систем, где они создаются, содержатся и где к ним обеспечивается доступ.

11. Качество данных предполагает разработку и внедрение методов управления качеством с целью измерять, оценивать и повышать пригодность данных к использованию внутри организации.

Руководству данными отведено центральное место в деятельности по управлению данными; именно оно обеспечивает согласованность и сбалансированность всех функций. Другие области (архитектура, моделирование и проектирование данных и т. д.) равномерно распределены вокруг центра колеса DAMA. Все области необходимы, чтобы управление данными можно было назвать зрелым, но реализовывать их можно постепенно и в том порядке, который отвечает нуждам организации. Проработка всех сегментов колеса позволяет построить полноценную систему управления данными — в этом состоит практический смысл этого инструмента.

Для каждой из областей знаний в DMBOK подробно описаны основные факторы, влияющие на эту область (см. рис. 7): это люди (их роли и ответственность), процессы и технологии.

Рисунок 7

Шестиугольник факторов среды

Наконец, контекстные диаграммы описывают для каждой области знаний цели, входные материалы (и их поставщиков), работы (и их участников), результаты (и их потребителей), а также методы, инструменты и метрики.

Колесо DAMA отражает набор областей знаний на верхнем уровне; шестиугольник факторов среды показывает общие структурные элементы этих областей на более низком уровне; контекстные диаграммы детально представляют устройство каждой области.

Колесо DAMA отражает набор областей знаний на верхнем уровне; шестиугольник факторов среды показывает общие структурные элементы этих областей на более низком уровне; контекстные диаграммы детально представляют устройство каждой области.

Изучение методологии DAMA-DMBOK и основных областей управления данными, составляющих колесо DAMA, может стать первым шагом на пути к полноценному управлению данными.

1.3.3 ВИДЫ УПРАВЛЕНИЯ В ОБЛАСТИ ДАННЫХ

Изучение методологии DAMA-DMBOK и основных областей управления данными, составляющих колесо DAMA, может стать первым шагом на пути к полноценному управлению данными.

Рассмотрим термины, применяемые к деятельности по управлению данными:

- управление данными (Data Management, DM);

- управление информацией (Information Management, IM);

- управление корпоративной информацией (Enterprise Information Management, EIM);

- управление информационными активами (Information Asset Management, IAM).

Согласно определению DMBOK, управление данными — это разработка, выполнение и контроль выполнения политик, программ и практик предоставления, проверки, защиты и повышения ценности данных на протяжении всего их жизненного цикла. Поскольку в DMBOK термины «информация» и «данные» в применении к управлению данными с известными оговорками взаимозаменяемы (соотношение этих терминов будет подробно обсуждаться в главе 2), «управление данными» и «управление информацией» также описывают одну и ту же реальность. Джон Лэдли отмечает, что рекомендации DMBOK для управления данными применимы как на локальном уровне (на уровне отдельных подразделений), так и на корпоративном (уровне организации в целом).

В этой главе мы берем за основу определения из DAMA-DMBOK.

Ladley J. Data Governance: How to Design, Deploy, and Sustain an Effective Data Governance Program: 2nd Edition. Academic Press, 2020.

Управление корпоративной информацией подразумевает управление на уровне всей организации, причем под это определение подпадают не только коммерческие структуры, но и министерства, ведомства, любые большие организации.

Управление информацией и управление корпоративной информацией обычно рассматриваются как программы в смысле подхода Program Management, под программой понимается «совокупность взаимосвязанных проектов и другой деятельности, направленных на достижение общей цели и реализуемых в условиях общих ограничений».

Управление информацией и управление корпоративной информацией обычно рассматриваются как программы в смысле подхода Program Management, под программой понимается «совокупность взаимосвязанных проектов и другой деятельности, направленных на достижение общей цели и реализуемых в условиях общих ограничений».

См. ГОСТ Р 54 871−2011. Проектный менеджмент. Требования к управлению программой.

Важное отличие управления корпоративной информацией от управления данными вообще — подход к данным как к активу (см. раздел 1.2). В этой связи четвертый ключевой термин в области управления данными — управление информационными активами. Это набор принципов и концепций, в котором данные рассматриваются как стратегически важный актив организации. Управление информационными активами можно воспринимать как новый, датацентричный образ мышления.

Основные аспекты IAM отражены в книге: Лейни Д. Инфономика. Информация как актив: монетизация, оценка, управление. М.: Точка, 2020.

Между управлением информационными активами и управлением корпоративной информацией существует неразрывная связь: первое поставляет концепции, а второе, будучи программой (см. выше), реализует эти концепции. Далее управление данными мы будем обсуждать именно в контексте управления корпоративной информацией.

DAMA International is dedicated to advancing the concepts and practices of information and data management and supporting DAMA members and their organizations to address their information and data management needs.

To fulfill this mission, DAMA-I sponsors and facilitates the development of the Data Management Body of Knowledge (the DMBoK) through its community of experts as well as developing certification and training programs

DATA MANAGEMENT BODY OF KNOWLEDGE

DMBOK2

DMBOK2 has been in the making for nearly 30 years. The contributors are all experienced practitioners and many of whom you see as contributors have recognizable names. This is not a theoretical book, although it has authoritative theoretical substance. It is primarily a book of practice, experience, expression of what actually works by the very best practitioners in the industry today.

Learn More

DAMA INTERNATIONAL

DICTIONARY OF TERMS

The DAMA Dictionary of Data Management (2nd edition) includes over 2000 terms defining a common data management vocabulary for IT professionals, data stewards and business leaders. Over 40 topics including finance and accounting, knowledge management, architecture, data modeling, XML, and analytics.

Learn More

DOWNLOAD CASE STUDIES

DATA MANAGEMENT BODY OF KNOWLEDGE

Across

Vendors

Introduction

The Certified Data Management Professional (CDMP) credential is awarded to those who qualify based on a combination of criteria including education, experience and test-based examination of professional level knowledge. This credential is offered at the Mastery or Practitioner level. To maintain certified status and continued use of the credential, an annual re-certification fee along with a 3-year cycle of continuing education and professional activity is required.

The Data Management Association International (DAMA) authorizes the Certified Data Management Professional certification program and granting of the CDMP designation in partnership with the Institute for Certification of Computing Professionals (ICCP), which administers testing and re-certification. This document outlines the requirements for obtaining the CDMP.

CDMP Application Form (Download PDF Document)

CDMP FAQ

CDMP Examination Criteria

Three ICCP exams must be passed with the following scores:

| Score | Credential Earned |

|---|---|

| Pass all exams at 50% or higher | CDMP Practitioner Certificate |

| Pass all exams at 70% or higher | CDMP Mastery Certificate |

The CDMP Practitioner certification is awarded to professionals who scored above 50% on all three exams. These individuals can contribute as a team member on assigned tasks for they have a working knowledge of concepts, skills and techniques in a particular data specialization.

The CDMP Mastery certification is awarded to professionals who scored 70% or higher on all three exams. These individuals have the ability to lead and mentor a team of professionals as they have mastered the concepts, skills and practices of their data specialization.

Exams may be retaken to improve your score and go from the Practitioner to the Mastery certificate level.

Additional CDMP Certification Criteria

The following criteria must also be met in order to qualify for the CDMP:

| CDMP Practitioner Certificate | CDMP Mastery Certificate | |

|---|---|---|

| # Years Data Professional Work Experience | 2 | 4+ |

| Substitute Up to 2 Years –Bachelor or Master Degree in an appropriate discipline for Work Experience | 2 | 2 |

| Recertification Required | Yes | Yes |

| Continuing Professional Education/Activity Required | 120 hours every 3-year cycle | 120 hours every 3-year cycle |

| ICCP Code of Ethics | Yes | Yes |

Example Qualifications – CDMP

Other qualifications may be accepted. Check with the DAMA contacts or ICCP office.

Education

Sample degree types are listed below. Other degrees and majors may be accepted.

Bachelor of Science Degree

Major In

- Computer Science

- Information Systems

- Management Information Systems

- Information and Communications Technology

- Major in another discipline with minor in any of the above

Masters Degree

- Computer Science

- Information Systems

- Information Resource Management

- Information and Communications Technology

- MBA with concentration in one of the above

Work Experience

Sample qualifying position/role titles:

- VP, Director, or Manager of Data Management

- Data Architect, Data Administrator, Data Analyst, Data Modeler

- Data Specialist, Database Administrator, Data Warehousing Analyst

- Systems Architect, Systems Analyst, Project Manager, Project Leader

- Business Analyst, Repository Analyst, Repository Architect

Professional Examinations

The CDMP requires three ICCP exams: IS Core exam, Data Management Core exam, and one other exam of your choice. Both the IS Core and Data Management Core exams are mandatory for the CDMP.

The third exam is one of your choosing, depending on your work experience. The choices are:

- Data Warehousing

- Business Intelligence and Analytics

- Data & Information Quality

- Data Development

- Data Operations (DBA)

- Zachman Enterprise Architecture Framework2

Institute for the Certification of Computing Professionals (ICCP) If you already passed one or more ICCP exams or already have another ICCP certificate, these exams or certificates can be used toward a CDMP if considered current by ICCP standards, and the exams are listed within your CDMP area of specialization. For information on your status, contact the ICCP (click here).

If you wish to demonstrate expertise in exam specialty areas specifically, the ICCP will issue Expert (Proficiency) Certificates for each specialty exam passed at 70% or higher.

Suggested Exams Based on Candidate’s Work Experience

The following table shows data work experiences organized by the DAMA – DMBOK (Data Management Body of Knowledge) framework, and possible exams to take within that framework. A suggested (S) exam is best to take for a particular data management function to fulfill the data exam requirement. An exam denoted by (C) is the candidate’s choice for that function. A total of three exams are to be taken. The IS Core exam is mandatory for all data management functions. Your work experience in the field will let you determine what exams you are best suited to pass.

View Sample Exam Combinations by DAMA – DMBOK Functions (pdf format) to relate your work experience.

UPDATED AUGUST 2010 View CDMP Specialty Exams Mapping to DAMA-DMBOK graphic (pdf format).

Preparation for Taking Exams

There are various ways of learning the process of taking ICCP exams:

- Sponsor ICCP Exam Review courses for your DAMA chapter membership

- Refer to the exam subject outlines (at level 1 & 2) posted on http://www.iccp.org/iccpnew/outlines.html to become familiar with the subject coverage of each exam

- Contact the ICCP (click here) for the CDMP Exam Study Guide which covers all the exams in the CDMP program and has sample exams/questions for self-study

- Contact ICCP website at http://www.iccp.org/iccpnew/training.html for the individual Data Management Exam Study Guide and/or the individual Data Warehousing Exam Study Guide.

- Check the ICCP website at http://www.iccp.org/iccpnew/training.html for scheduled online CDMP exam reviews and http://www.iccp.org/iccpnew/ccpreview.html for other training.

The exams are also offered at the DAMA International Symposiums and periodically at some DAMA chapter meetings.

Taking CDMP Exams

ICCP Testing can be done anywhere in the world, with an approved Proctor to verify physical identity and supervise/invigilate the delivery of the examination.

A DAMA chapter can set up exam sessions during their chapter meetings. What is needed is a volunteer proctor from the chapter. A proctor is an individual authorized by ICCP to oversee the writing of an exam by an exam taker. This person must meet specific guidelines (http://www.iccp.org/iccpnew/testing.html) and be willing to supervise the exam taker. Contact DAMA DACH (phone +41 43 542 5906) if you require assistance in determining an appropriate proctor. Taking exams via the Internet is also available.

The exams run off the USB drive of an individual’s laptop. There are 110 questions with 100 being scored and reported to the exam taker and 10 are beta questions to complete in 90 minutes. You will not know which type of question you are answering. Questions and possible distracters (answers) are randomly listed in a different order for each exam taker. Therefore, although this guide contains sample questions that allow for “all or none of the above” type answers meant for study purposes, you will not find this type of answer to choose from on the actual exam.

Computer based testing allows for the immediate scoring after the exam is taken. An Performance Profile is then available for downloading, and one will be sent later to the individual by the ICCP. This Profile shows your exam strengths and weaknesses.

CDMP Certificate Conversion & Fees

View CDMP Certificate Conversion and Fees (pdf format)

Professional Development / Recertification

To keep your CDMP current, you must earn 120 approved contact hours of continuing education over a 3-year period. Many educational activities count including DAMA Symposiums and chapter meetings. View the Sample Ways to Earn CDMP Professional Development /Recertification Credit in pdf format.

For further information, contact DAMA DACH for Re-certification Guidelines Booklet or go to http://www.iccp.org/iccpnew/recertification.html.

Re-certification credits can be entered online through the Professional Development Transmittal Form, http://www.iccp.org/cgi-bin/pdform.php. Your DAMA chapter can also keep track of meeting attendance for the purpose of re-certification and submit on a timely basis. There is an annual maintenance fee to keep track of your re-certification credits. You will receive an annual transcript from the DAMA DACH.

Program Contact information:

DAMA DACH:

Management Team (Benjamin Kissling, A.J. Rayvadera, Nitesh Gandhi, Heike Wiegand, Kamal Singh, info@damadach.org

DAMA DACH Office:

+41 43 542 5906 (phone)

The CDMP program was approved and came into existence at the January 2004 Meeting of the DAMA International Board of Directors.

Управление данными:

DAMA DMBOK2

Data Literacy Project в России запускает проект по популяризации «DAMA-DMBOK2: Cвода знаний по управлению данными». Эта книга написана экспертами Международной ассоциации управления данными (DAMA) и представляет собой наиболее полное и актуальное введение в дисциплину управления данными с обзором лучших практик.

DAMA-DMBOK2 действительно можно назвать сводом знаний. К примеру, только для написания первой главы составители осмыслили и переработали более 40 книг и научных статей по работе с данными. Поэтому, мы будем разбирать этот труд постепенно и осознанно, в течении года.

где собираем наиболее важные идеи одной главы книги DMBOK2 в формате привычного текстового конспекта

где обсуждаем ключевые темы главы с экспертами-практиками, чтобы обогатить свои знания кейсами и советами, а также ответить на ваши вопросы

Содержание конспектов

Мы публикуем новые главы книги примерно раз в месяц — кратко, тезисно, наглядно

Онлайн-дискуссии

Каждая глава сопровождается бесплатным вебинаром, на который мы приглашаем экспертов из бизнеса

DAMA — это международная ассоциация управления данными (Data Management Association International), которая объединяет профессионалов как из сферы ИТ, так и бизнеса, и развивается абсолютно независимо. Уже 40 лет ассоциация DAMA собирает, систематизирует и пропагандирует лучшие практики по управлению данными и информацией. При этом, важная задача ассоциации — выработка единой терминологии и подхода к управлению данными

Книга DAMA DMBOK2, как и сама ассоциация, абсолютно независима — она не ссылается на какие-то конкретные решения по работе с данными или вендоров, а определяет набор принципов и их применение в функциональных областях управления данными

Какие задачи ставит перед собой DAMA DMBOK2?

→ Выработка общепринятого согласованного представления об областях знаний по управлению данными (выделено 11 таких областей)

→ Определение руководящих принципов управления данными

→ Предоставление стандартных определений для наиболее часто используемых понятий

→ Обзор общепринятых лучших практик, широко распространенных методов и методик, а также наиболее известных альтернативных подходов

→ Краткий обзор общих организационных и культурных вопросов

→ Уточнение границ сферы управления данными

Не каждый должен получать высшее техническое образование, но навык грамотной работы с данными уже является базовым

Что говорят те, кто уже читал книгу DMBOK2?

Мы спросили мнение тех, кто уже прочитал практический свод знаний и сделал свои выводы

Иван Черницын

руководитель центра аналитических решений,

Дирекция региональных продаж, Газпромнефть

DAMA — это международная ассоциация по управлению данными, а DMBOK — это книга лучших практик по управлению данными. В июле 2017 года вышло второе издание книги, которое я очень рекомендую прочитать. Книга дает очень системное, проработанное представление, что BI является частью очень комплексных процессов, какие роли должны быть, и куда приведет грамотное управление данными.

Данила Наумов

Директор управления данными, Утконос

Я бы посоветовал DAMA DMBOK — это свод знаний об управлении данными, который написан бизнесовым и верхнеуровневым языком, понятным как людям из бизнес-направлений, так и уже имеющим опыт в управлении данными. И самое главное: книга не привязана к вендору, и она очень и очень близка к реальности

Подписывайтесь на новые выпуски проекта

Получайте обновления конспекта DMBOK2 себе на почту по мере их публикации

Международная профессиональная сертификация специалистов в области управления данными Certified Data Management Professional (CDMP) разработана организацией DAMA International. Вся информация о сертификации доступна на официальном сайте cdmp.info.

Всего существует 4 уровня сертификации CDMP: Associate, Practitioner, Master и Fellow. Предполагается, что их надо сдавать последовательно, но ничего не мешает опытному эксперту при соблюдении определенных требований сдавать сразу на CDMP Master. Первые три звания можно подтвердить путем сдачи экзаменов, дополнительное звание Fellow предназначено для заслуженных и международно признанных экспертов по принципу «globally recognized & respected thought leadership», для его получения нужно иметь CDMP Master и быть номинированным коллегиальным советом DAMA. Подробные условия для получения каждого из сертификатов представлены в таблице.

| Условие | CDMP Associate (кандидат) |

CDMP Practitioner (специалист) |

CDMP Master (мастер) |

CDMP Fellow (коллегиальный член) |

| Сдача базового экзамена Data Management Fundamentals ($300) | Да, не менее 60% верных ответов | Да, не менее 70% верных ответов | Да, не менее 80% верных ответов | Необходим СDMP Master |

| Сдача 2х экзаменов по выбранным специальностям (2x$300) | – | Да, каждый не менее 70% | Да, каждый не менее 80% | Необходим СDMP Master |

| Опыт работы в сфере управления данными | От 2 месяцев до 5 лет | От 2 до 10 лет | Более 10 лет | Более 25 лет |

| Дополнительные требования | – | – | Резюме, подтверждающее опыт работы | Номинирование действующими коллегиальными членами DAMA по принципу «globally recognized & respected thought leadership» |

Базовый экзамен «Основы управления данными (Data Management Fundamentals)» должен быть пройден всеми кандидатами, а результат его сдачи задает границы потенциального уровня сертификата CDMP. Это значит, что в случае правильного ответа на 60-69 вопросов из 100 (60-69%) базового экзамена, кандидат получает звание CDMP Associate и он не может претендовать на другие звания без пересдачи экзамена. В случае 70-79% правильных ответов кандидат получает CDMP Associate может претендовать только на уровень CDMP Practitioner. В случае 80% и более правильных ответов кандидат получает CDMP Associate и может претендовать на CDMP Master. Для званий Practitioner и Master необходимо сдать два дополнительных экзамена по специальности из следующих (на выбор):

- администрирование данных (Data Governance Exam)

- метаданные (Metadata Exam)

- моделирование данных (Data Modeling and Design Exam)

- качество данных (Data Quality Exam)

В ближайшем времени ожидается появление экзаменов по другим темам и разделам DMBoK.

Экзамены проводятся на английском языке в виде теста из 100 теоретических и практических вопросов, в которых необходимо выбрать 1 правильный ответ из 5 предложенных вариантов. Продолжительность тестов ограничена 90 минутами, в 2019 г. для неносителей английского языка на сайте предложен вариант в 110 минут с пометкой ESL (english second language). Стоимость первой попытки при сдаче любого экзамена – $300. За каждую следующую попытку придется отдать еще $200.

С 2019 г. экзамены проходят на новом онлайн портале. Там же можно найти пробный экзамен (Practice Exam) для Data Management Fundamentals. Количество попыток для сдачи пробного экзамена не ограничено, в каждой попытке будет предложено 40 вопросов, которые необходимо решить за 30 минут. Отдельно такой экзамен стоит $40, но покупать его бессмысленно, т.к. он будет также доступен при оплате Data Management Fundamentals.

Рекомендованная литература для подготовки к экзамену включает следующий перечень. Официальные онлайн курсы по подготовке к сертификации расположены на сайте DAMA Australia. Помните, что все на английском языке, как и сам экзамен, но смысла в подготовке нему на другом языке наверное мало.

Экзамены можно сдать двумя способами:

- классический способ с очной явкой (exam event) проводится активными отделениями DAMA под присмотром экзаменаторов, которые осуществляют проверку документов экзаменуемых, выдают временный код доступа для входа на портал. После прохождения экзамена.

- Дистанционная сдача онлайн-экзамена доступна с мая 2019 г. Каждый экзамен будет стоить $300. При неудачной попытке, каждая следующая придется отдать еще $200. За дистанционную проверку (online proctoring) придется доплатить еще $11. Обязательными условиями являются наличие веб-камеры и микрофона на ноутбуке.

После успешной сдачи экзаменов и соблюдения прочих условий выдается онлайн-сертификат, который действует 3 года. Для продления сертификата необходимо иметь членство DAMA и пройти обучение от 30 часов или принять участие в специализированных мероприятиях, таких как конференция Enterprise Data World, Data Architecture Summit и другие, либо пересдать экзамены для обновления сертификата.

Время на прочтение

15 мин

Количество просмотров 3.4K

В самом начале нового рабочего года — несколько слов об одном из событий года прошедшего.

Введение

Data Modeling Zone — франшиза, которая объединяет конференции по вопросам построения логической архитектуры баз данных. Последние несколько лет проводилась в США и Европе, а в этом году впервые пройдет в Австралии. В 2017 году под брендом DMZ было организовано два форума, оба прошли осенью: 16—18 октября — в Хартфорде, США, а 23—25 октября — в немецком Дюссельдорфе. Мне довелось принять участие в роли слушателя в последней из них. В этой статье представлен краткий обзор презентаций, которые я увидел на конференции, и мои впечатления о ней в целом.

Название конференции недвусмысленно намекает, что ключевой вопрос — разные аспекты построения модели данных. Большинство анонсированных тем связаны с хранилищами данных, но были и актуальные для любой информационной системы. Мои ожидания были противоречивыми: с одной стороны, в числе выступающих — признанные лидеры сообщества, с другой — обилие часовых презентаций, не предусматривающих глубокого рассмотрения вопросов.

Основная программа была представлена пятью треками:

- Foundational Data Modeling

- Agile and Requirements

- Big Data and Architecture

- Hands-On and Case Studies

- Advanced Data Modeling

каждый из которых был поделен на 11 временных слотов в течение двух дней. Временная нарезка у всех пяти треков была общая, что позволило комбинировать презентации из разных блоков.

1-й день

Регистрация

Вместе с бейджем участникам выдавался набор наклеек. С их помощью владелец бейджа мог указать языки, на которых говорит, и выбрать одну или несколько профессиональных ролей. Идея оригинальная и занятная, но бесполезная.

Send Bitemporal data from Ground to Vault to the Stars

Первый день начался с трехчасовой лекции о различных аспектах версионного сохранения данных. Построение историчности — тема, вокруг которой велось много оживленных споров внутри нашей команды. Поэтому я не смог пройти мимо ключевых слов merging timelines, Data Vault Satellites, historization в анонсе выступления.

Докладчик — Дирк Лернер, один из миссионеров Data Vault в Германии, учредитель компании TEDAMOH (The Data Modeling Hub), автор неплохого профессионального блога.

Презентация началась с обзора форматов записи интервалов времени. Рассмотрели 4 формата, отличавшихся способом записи начала и конца интервала: open или closed. В первом примере была выбрана последовательность двух интервалов: T1 = 2016 год, T2 = 2017 год. Из объяснений я понял, что открытый формат записи границы интервала (open) подразумевает исключение границы, а закрытый (closed) — включение. Наподобие того, как записываются числовые интервалы в алгебре.

| Формат | T1 | T1 |

|---|---|---|

| Closed / Closed | Jan16 — Dec16 | Jan17 — Dec17 |

| Closed / Open | Jan16 — Jan17 | Jan17 — Jan18 |

| Open / Closed | Dec15 — Dec16 | Dec16 — Dec17 |

| Open / Open | Dec15 — Jan17 | Dec16 — Jan18 |

Но следующий пример поставил меня в тупик. В нем был один интервал — период проведения конференции. Первый пункт задачи (closed/closed) ни у кого не вызвал затруднений. А вот по поводу трех остальных возникла дискуссия, в ходе которой определения всех форматов окончательно прояснились.

Суть в том, что граница периода в формате open обозначается первым определенным значением из смежного периода. То есть «открытый» конец периода обозначается как первый такт следующего периода, а начало — как последний такт предыдущего. Периоды из первого примера имели «соседей» по факту их принадлежности к григорианскому календарю. Второй пример был более конкретным и локальным, поэтому определить границы предложенного интервала через «открытый» формат было невозможно.

В завершение говорили о предпочтительности формата close/open, поскольку именно он позволяет не зависеть от величины такта часов системы наблюдения. Действительно, если строить непрерывную историю изменения состояния объекта, то окончание текущего периода происходит в момент смены состояния, то есть с началом следующего периода. Чтобы вычислить окончание закрывающегося интервала при использовании формата close/close, приходится от времени, когда зафиксировано новое состояние, отнимать 1 такт часов. Тогда как использование формата close/open позволяет время смены состояния указать и в качестве начала нового периода, и в качестве конца старого. И неважно, в каких единицах измеряется время — формат close/open независим от величины такта часов хранилища. Это одна из причин, по которой он наиболее популярен и внесен в стандарт ISO 9075:2011.

Следующей темой была классификация пересечений временных интервалов. Дирк наглядно продемонстрировал, как не запутаться в вопросах, которые кажутся очевидными. По существу — ничего нового, но системность рассмотрения вопроса производит приятное впечатление.

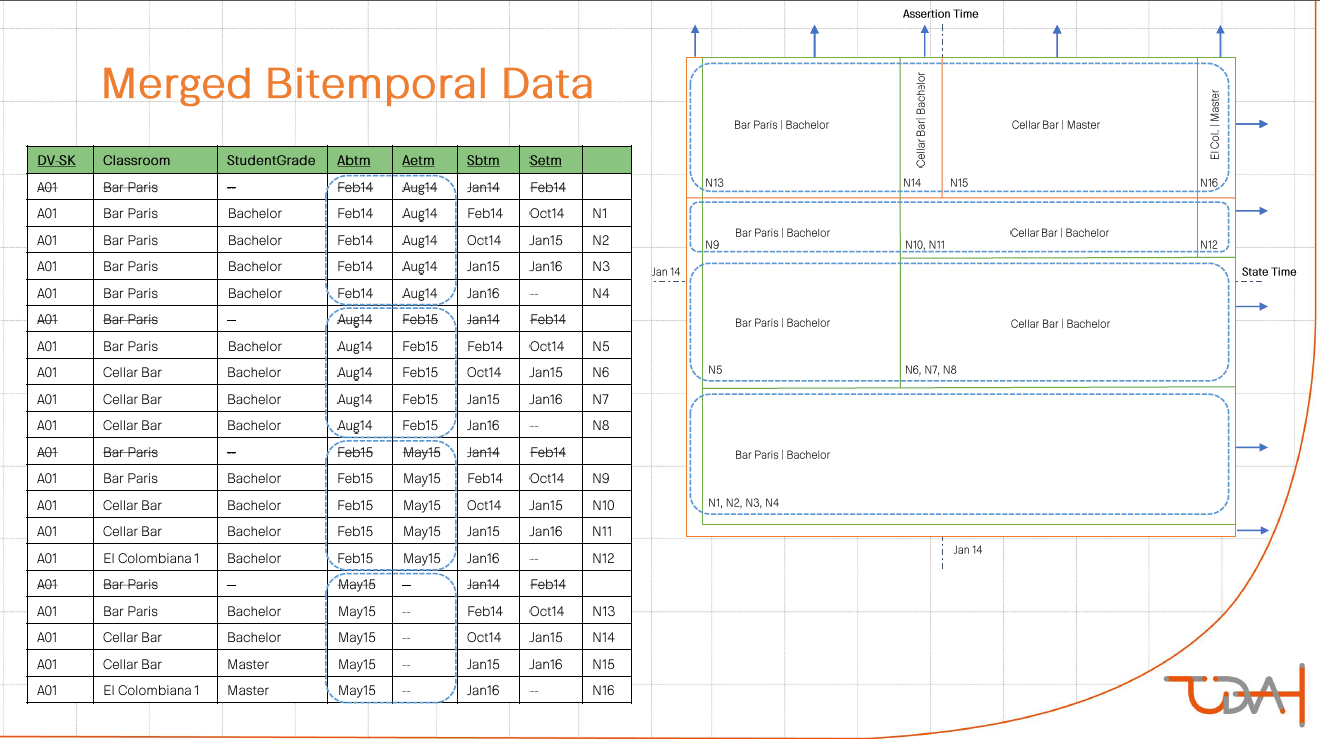

Но всё это было разминкой перед основной темой презентации, а именно — сохранением данных в разрезе двух хронологий: бизнесовой и технической. Необычное слово bitemporal в названии темы — как раз об этом. Дирк начал с достаточно простого абстрактного примера, в котором на входе мы имеем массив данных с ключом, парой бизнес-атрибутов, датой начала актуальности записи с точки зрения бизнеса и датой загрузки данных в staging.

StagingTable

| SomeBK | Attr_1 | Attr_2 | ValidFrom | STGLoadDTS |

|---|---|---|---|---|

| %662HK!..? | 10 | 10 | 2014-12-01 | 2015-01-01 |

| %662HK!..? | 11 | 10 | 2015-01-03 | 2015-02-10 |

| %662HK!..? | 11 | 100 | 2015-03-30 | 2015-02-23 |

Satellite

| H_ID | Attr_1 | Attr_2 | Tech_from | Tech_to | Bsns_from | Bsns_to |

|---|---|---|---|---|---|---|

| 1 | 10 | 10 | 2015-01-01 | 2015-02-10 | 2014-12-01 | 2999-12-31 |

| 1 | 10 | 10 | 2015-02-10 | 2999-12-31 | 2014-12-01 | 2015-01-03 |

| 1 | 11 | 10 | 2015-02-10 | 2015-02-23 | 2015-01-03 | 2999-12-31 |

| 1 | 11 | 10 | 2015-02-23 | 2999-12-31 | 2015-01-03 | 2015-03-30 |

| 1 | 11 | 100 | 2015-02-23 | 2999-12-31 | 2015-03-30 | 2999-12-31 |

Идея заключается в том, чтобы сохранять историю изменений истории. Рассмотрим обработку первых двух записей из staging. С первой записью проблем нет — на момент ее загрузки не идет речи об обработке изменений. В сателлит добавляется запись о том, что у заданного ключа вектор атрибутов (10,10) — «на века». Вторая запись из staging содержит обновление по одному из атрибутов, в результате чего вектор принял значение (11,10). Для обработки этого события необходимо сделать три действия:

- Сохранить информацию, что в период с момента получения данных о первом значении (10,10) до получения данных о втором (11,10) мы думали, что значение (10,10) — «на века». Для этого мы обновляем первую запись закрыв ей интервал «технической» актуальности, оставив открытой «бизнесовую».

- С момента получения данных (11,10) мы знаем, что значение (10,10) было актуально только в определенный период времени, и это наше знание уже не подлежит пересмотру. Для сохранения этой информации мы вставили вторую запись с (10,10) с открытым интервалом «технической» актуальности, но с закрытым «бизнесовой».

- Для сохранения нашего актуального представления, что значение (11,10) действительно сейчас и будет таковым в течение неопределенного будущего, вставляется третья запись именно с этим значением вектора атрибутов и открытыми интервалами и «технической», и «бизнесовой» актуальности (на слайде у этой записи «технический» интервал закрыт, потому что сателлит содержит результаты обработки последующих обновлений).

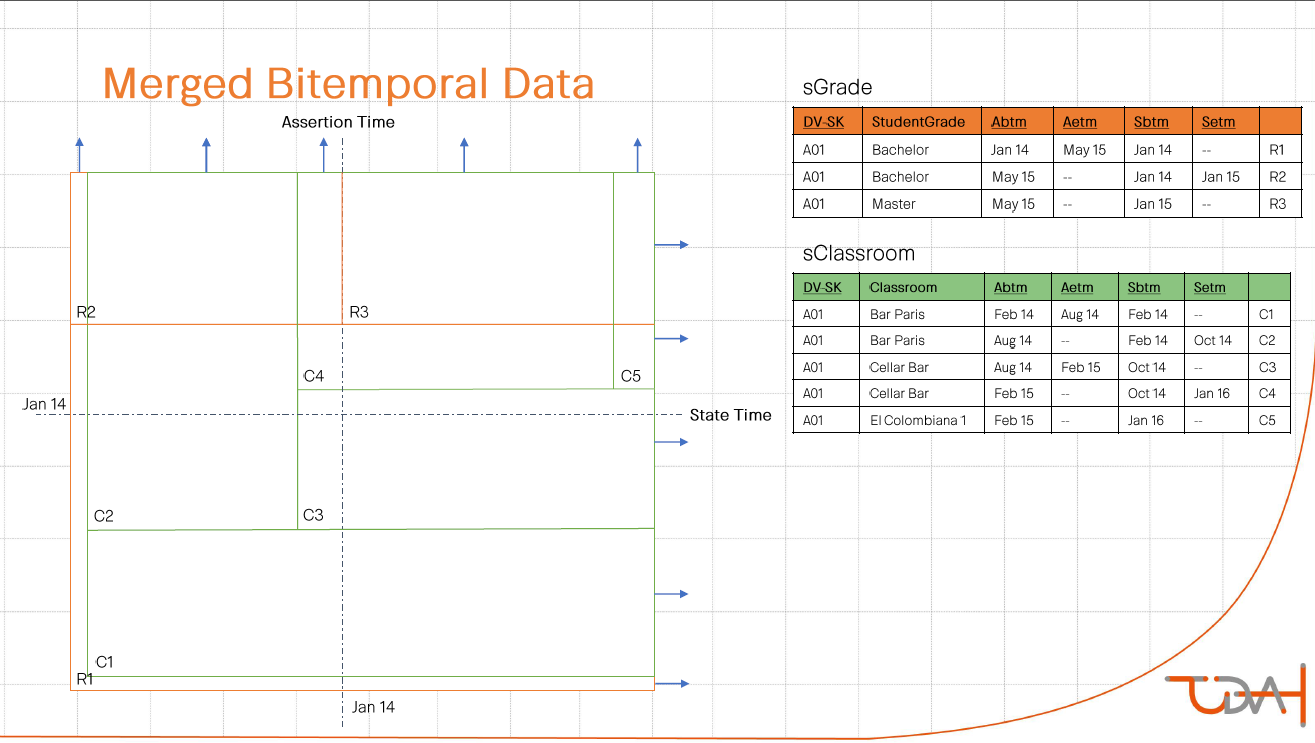

Следующий пример слушатели решали самостоятельно. В нем речь шла о студенческом расписании.

Для демонстрации решения использовалась любопытная визуализация. Двойная историчность была представлена в виде координатной плоскости. На оси абсцисс — бизнес-время, на оси ординат — техническое. Каждой записи соответствует одна из областей плоскости. Нарезка идет по диагонали — направо и вверх.

Заключительный пример был самым сложным. Исходные данные — план изменения цен в привязке ко дню проведения маркетинговой акции «Черная пятница».

Staging Table

| Product | Price | DayStart | DayEnd | STG Load DTS |

|---|---|---|---|---|

| Jeans | 100 | D1 | BF | D1 |

| Jeans | 80 | BF | BF+w | D1 |

| Jeans | 110 | BF+w | 9999 | D1 |

| Jeans | 95 | D1 | BF | D10 |

| Jeans | 82 | BF | BF+2w | D10 |

Сложность была в том, что план пересматривался не только в части изменения самой цены, но и в части разбивки временного континуума решения. Отмечу, что ключом к успешному выполнению задания стало понимание, что для любого момента «технического» времени в хранилище должны быть данные, полностью покрывающие всю «бизнесовую» хронологию. Не без усилий задачу удалось решить «на бумажке», но вопрос автоматизации этого не самого тривиального алгоритма остался открытым.

Следующим пунктом программы было описание, как сливать информацию из двух сателлитов с двойной историчностью в одно измерение. Для демонстрации выбрали пример со студентом с определенным расписанием занятий. У него есть история изменения ученой степени. Суть предложенного метода: cross join со схлопыванием последовательных интервалов.

Последним рассмотренным аспектом этой темы была вариантивность в интерпретации информации, полученной на выходе. Есть факт сдачи студентом экзамена. Информацию о расписании и ученой степени студента для этого факта мы можем определять тремя разными способами:

- Что нам известно сейчас о расписании и степени, актуальной на сегодня.

- Что нам известно сейчас о расписании и степени, актуальной на момент сдачи экзамена.

- Что нам было известно на момент сдачи экзамена о расписании и степени, актуальных на момент сдачи экзамена.

Пожалуй, именно эта презентация была самой содержательной и познавательной лично для меня. После нее последовал блок выступлений в жанре key notes.

Официальное открытие

Организаторы произнесли набор дежурных фраз, из которых запомнилось упоминание о гендерном распределении среди участников: 165 мужчин на 17 женщин. После чего на сцену вышла «рок-звезда» моделирования данных, автор многочисленных книг по теме — Стив Хоберман. Стив рассказал о том, что сегодня самые популярные в этой области IT вопросы — nosql базы данных и взращивание новых моделеров. На втором он остановился подробнее, рассказав, что рост объема метаданных значительно превышает рост числа моделеров. В связи с этим он выделил 5 самых востребованных в ближайшие годы навыков:

- Общения

- Моделирования

- Управления данными в парадигме Agile

- Знание различных типов СУБД

- Знание бизнес-процессов

Data, a Managerial Perspective

Следующим спикером был архитектор данных центробанка Нидерландов — Рональд Дамхов. Рональд рассказал, как ему с коллегами удалось построить хранилище по принципу «мультиреальности». Речь шла о методологии, которая:

- предусматривает одновременно и полноту отражения источников, и адекватное представление бизнес-контекста;

- позволяет использовать преимущества гибкого подхода к разработке вместе с четкой регламентацией процессов изменения.

Идея в том, чтобы представить все хранилище в виде квадранта, построенного в системе координат «гибкость-систематизация» + «источники-бизнес» и разделенного на 4 сектора:

При этом подчеркивалось, что разделение данных на «мастер-данные», «большие данные», «метаданные» и прочие неэффективно.

В полученной системе координат был порядок решения каждой из 7 основных задач по проектированию ХД:

- Построение

- Автоматизация

- Систематизация

- Управление

- Доступ пользователей

- Обеспечение технологичности

- Моделирование

Для решение вопроса построения, например, предложили варианты (зеленый — ok, красный — не ok):

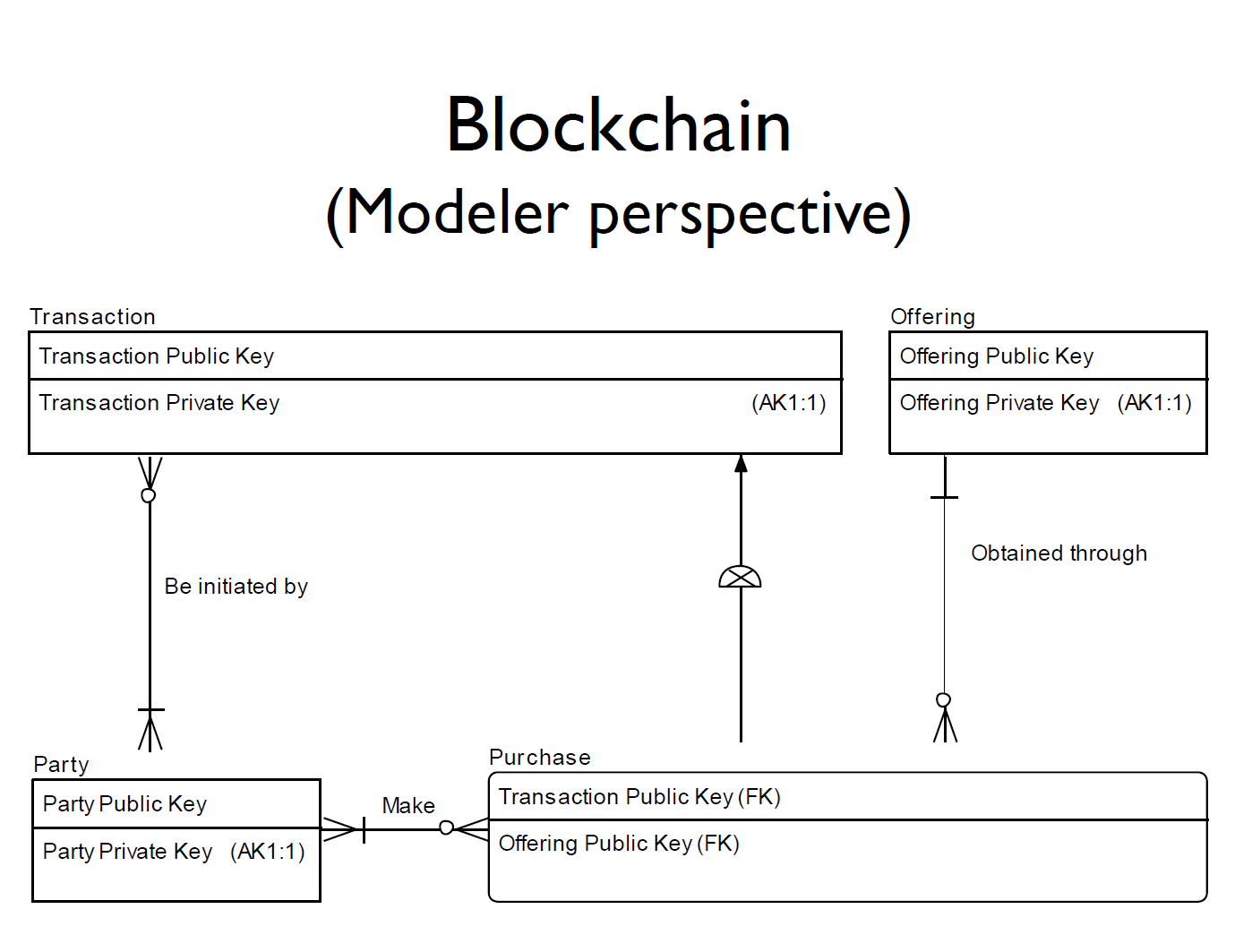

The Blockchain Billionaire

После Рональда слово опять взял Стив Хоберман. Он рассказал, как главный определяющий фактор развития IT в ближайшем десятилетии — технология блокчейн — влияет на вопросы моделирования данных. Поскольку Стив — гуру моделирования всего и вся, блокчейну сразу было дано определение в виде логической модели данных.

По мнению Стива наиболее сильно влияние блокчейна будет ощущаться в вопросах управления данными, стандартизации данных и проектирования архитектуры систем хранения данных. Блокчейн вряд ли коснется вектора развития реляционных СУБД. А вот как он скажется на методологии Agile — пока непонятно.

Любопытно, что в качестве примера распространения этой технологии Стив рассказал об украинском проекте, в рамках которого предлагается перейти на использование криптовалюты для расчета по сделкам продажи госсобственности. Это должно помочь в борьбе с коррупцией.

Introducing the DAMA DMBOK2 certification

Всем желающим предложили потренироваться в сдаче самого известного в сфере управления данных сертификационного DAMA DMBOK2. Тренировочные вариант экзамена включал в себя 20 вопросов. Например:

- Кто является «поставщиком» в контексте процесса управления данными?

- Какие активности включены в процесс разработки данных?

- Какие действия по поддержке являются базовыми для построения надежной системы хранения данных?

- Кто наиболее заинтересован в качественно внедренном процессе управления данными?

И так далее.

Любопытная теория. Достаточно абстрактная, вместе с тем последовательная и логичная.

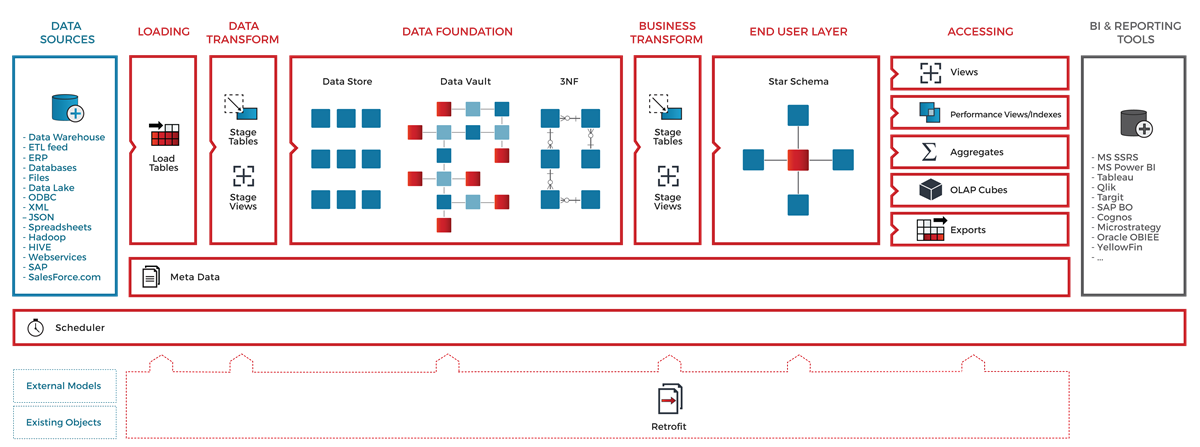

Wherescape Test Drive

Изначально демонстрация системы, предоставляющей комплекс услуг по построению архитектуры хранилища, была запланирована в формате семинара. Но ноутбуков оказалось сильно меньше участников, поэтому формат изменили на презентацию.

В качестве преамбулы был декларирован ряд утверждений класса «Волга впадает в Каспийское море». Например, о том, что главное — это слушать бизнес, а автоматизация — часть процесса, а не техническое решение. Для примера был приведен провальный проект с заказчиком в лице российской компании, представители которой «полагали, что покупая систему, они покупают волшебную палочку». После презентации я подошел, чтобы расспросить поподробнее про этот проект. Но всё, что услышал — это просьбу не воспринимать эти слова как хулу русского народа — «эта ошибка свойственна всем». В завершение вступительной части был основательно раскритикован Power Designer — старый, некрасивый, сложный, смысла хранить версии нет.

Сама система в ходе демонстрации выглядела действительно эффектно. В деле мы увидели лишь часть возможностей, но было заявлено, что WhereScape Red обеспечивает полный набор возможностей по управлению метаданными и ETL. В качестве подтверждения была представлена схема, на которой красненьким были отмечены стандартные элементы архитектуры хранилища, охваченные функциональностью системы:

Начали с того, что модели систем источников описаны, их изменения отслеживаются. Сам процесс моделирования заключается в построении логической модели пользовательских витрин и определении маппингов их полей с источниками. После этого нажатием волшебной кнопки запускается процесс автоматического построения модели слоя staging и data vault в соответствии с заранее настроенными правилами. Последним шагом стала генерация ETL-кода и определение расписания. На примерах класса tutorial все работало, разумеется, складно и нарядно. Среди особенностей я бы выделил линейдж по колонкам. Верификации и валидации изменений пока нет, но в ближайшем релизе должны появиться. Больше о возможностях системы можно прочитать на странице вендора.

How to sell Data Vault to non-technical people

Первый день завершился самодеятельным юмористическим шоу. Сценки двух взрослых мужиков, лейтмотивом которых была самоирония по поводу ажиотажа вокруг Data Vault, наскучили после первых 15 минут, хотя всё представление длилось больше часа. Глядя на количество экранов телефонов, горящих в темноте, сложно было не проникнуться сочувствием к выступающим дяденькам.

2-й день

Developing Corporate Model Using Patterns

Трехчасовой семинар австралийца Джона Гиллза по сути был кратким изложением его же книги «The Nimble Elephant», выпущенной в 2012 году. Тема полезная и не теряющая своей актуальности. Речь идет об использовании промышленных шаблонов при проектировании модели. В настоящее время крупные вендоры (например, IBM и TeraData) предлагают готовые верхнеуровневые шаблоны модели для разных предметных областей — «Industry Reference Model». Самая общая классификация сущностей у многих шаблонов совпадает. Концепция, о которой рассказал Джон, — не исключение. Она предусматривает использование типов:

- Участник и роль

- Продукт

- Ресурс

- Задание

- Счет

- Соглашение

- Документ

- Событие

- Местоположение

На семинаре участникам нужно было по описанию производственной деятельности предприятия построить модель данных, описывающих этот бизнес-процесс. Предлагалось сделать это с помощью:

- создания подтипов разного уровня вложенности по отношению к перечисленным исходным типам;

- определения связей между ними.

Кроме этого, Джон представил точный план-график построения модели данных с использованием такого подхода:

- 1 неделя: ознакомление, драфт концептуальной модели.

- 2—4 недели: семинары по проблемным местам, итеративное развитие концептуальной модели через уточнение, создание расширений основных сущностей.

- 5 неделя: бизнес определяет приоритеты, IT начинает разработку.

- 6—8 недели: построение прототипа, запуск процесса agile-разработки.

Полученную концептуальную модель можно использовать не только для построения логической модели ХД, но и как единую формализованную бизнес-модель предприятия, в соответствии с которой следует создавать логические модели данных операционных бизнес-систем.

Advanced Data Modeling Challenges

Второй семинар, который мне удалось посетить, проводил Стив Хоберман. Стив известен не только своими книжками и запатентованной системой оценки качества модели «Data Model Scorecard». Он также популярен как преподаватель на семинарах и курсах по теме. В целом он подтвердил свою репутацию: рассказывал доступно, интересно и с юмором. Правда, название семинара не соответствовало действительности: речь шла о важных и полезных, но все-таки базовых принципах построения модели.

Сперва он рассказал про концепцию супер-сущностей и их расширений, что пересекалось с содержанием предыдущего семинара. После последовало задание: нужно было изучить небольшой набор данных, представленных в плоской денормализованной витрине и описывающих ассортимент книжного магазина, и построить 3NF-модель. По мнению Стива, выполняя это задание, мы должны были почувствовать себя археологами данных.

Следующее задание было более занятным. Исходными данными было расписание движения пригородных поездов по одному из направлений в окрестностях Нью-Йорка.

Задача заключалась в проектировании модели данных, на базе которой можно строить аналитику по качеству работы электричек, а именно — насколько точно выполняется расписание. Целевая модель должна была предусматривать сохранение данных и о расписании, и о фактическом графике движения поездов. Модели, представленные тремя командами, практически не отличались по набору сущностей, если не считать различий в названиях. То, что у нас принято называть «веткой» или «линией» в разных моделях называлось: line, journey, route, trip, а «перегон» — link или leg. Из этого было выведено одно из очевидных, но крайне важных правил моделирования — необходимость давать четкое, максимально исчерпывающее определение сущностям, представленным в модели. Принципиальным различием моделей был способ сохранения фактических данных о движении поездов: у части моделей гранулярность этих данных была определена как факт прибытия поезда от начальной станции к заданной. Альтернативным подходом было сохранение факта перемещения поезда между двумя соседними станциями. В ходе сравнения двух способов, мы пришли к выводу о том, как важно при построении модели помнить, какой процесс мы хотим измерять с ее помощью.

Кроме этого, различались парадигмы построения логических моделей: одна команда выбрала Multi-Dimensional, остальные — 3NF. На основе мы сформулировали тезис о приоритетности создания качественной концептуальной модели, которую без труда можно конвертировать в Multi-Dimensional, 3NF, Data Vault, и так далее.

Designing the Dream — Why Enterprises Need Architects

Пространная философская презентация о роли архитекторов в современном мире. Ключевую мысль лучше всего выражает цитата архитектора Нормана Фостера:

«As an architect you design for the present,

with an awareness of the past,

for a future which is essentially unknown».

Из великих еще был процитирован Аристотель с его словами о том, что архитектура держится на трех китах: долговечность, красота и функциональность.

Это было что-то обо всем и ни о чем протяженностью в час в формате keynote. Среди прочего стоит выделить крайне важное наблюдение: архитектор здания отличается от архитектора промышленной системы тем, что не встроен в объект своего творения.

Business Milestones and Data Models — an Introduction to Entity Life Histories

Не самая захватывающая презентация на тему того, как правильно сохранять историю изменения сущности. Ключевые мысли:

- Сохранять историю нужно максимально подробно, без какого-либо анализа.

- Важно разделять состояние сущности и новую сущность (кандидат — сотрудник, наряд — заказ).

- Не все статусы сущности одинаково полезны для аналитики — нужно схлопывать.

Для демонстрации этих хороших и важных мыслей был выбран примитивный пример с моделью жизненного цикла антилопы гну:

А для закрепления полученной информации нам предложили построить модель данных, позволяющую автоматизировать процесс гашения банковских чеков. Либо задача была сформулирована слишком абстрактно, либо участники к концу второго дня подустали, но в итоге готовых решений не было.

Migrating an Enterprise DW from “traditional” to Data Vault based

Автор — Габор Гольнхофер, архитектор с 20-летним опытом работы на проектах ХД в финансах, страховании, телекоме, ритейле и образовании. Презентованный проект заключался в переводе хранилища неопределенно-смешанной архитектуры на Data Vault. Название компании-заказчика не называлось, сказали лишь, что она лидер рынка в своей сфере в Венгрии и входит в международный холдинг. По «тактико-техническим характеристикам» их хранилище сопоставимо с нашим Tinkoff DWH:

- 40+ систем-источников.

- Вехи: 1998 — начало, 2008 — SAS → Oracle, 2016 — Data Vault.

- 22 TB,5000 таргет-таблиц, 9000 ETL-джобов.

C технической точки зрения главной предпосылкой к перестроению хранилища была дороговизна процесса доработок и проблемы с производительностью. Кроме этого, 20 лет эволюции, включающей переход от 3NF к Dimensional и внедрение версионности, привели к архитектурному хаосу. Со стороны бизнеса были требования: высокая скорость изменений, полнота сохранения истории, возможности для self-service BI. Короче говоря, как обычно — побольше, побыстрее и подешевле.

Основные проблемы, с которыми столкнулись коллеги, уверен, знакомы многим. Это и отсутствие в исходных данных подходящих бизнес-ключей, только суррогатные, и низкое качество исходных данных, и нарушения целостности в источниках. Также немало сил пришлось потратить на автоматизацию построения Dimensional — витрин на основе DV — и разработку шаблонов ETL-процедур для загрузки больших массивов данных. Пожалуй, ключевой особенностью проекта был упор на автоматизацию изменений модели и ETL, в результате чего:

- значительно увеличилась скорость внесения изменений,

- снизилось количество багов,

- качество и полнота документации повысились,

- соотношение разработчиков и аналитиков в составе команды изменилось в пользу последних.

Кроме этого, справедливо утверждалось, что Data Vault полезен в деле контроля качества данных, поскольку позволяет сохранять «факты», а не «правду».

Доклад получился интересным и содержательным. В личной беседе после презентации сошлись с Габором в том, что Data Vault не стоит воспринимать как догму, но адаптировать под нужды конкретного проекта.

Итого

Резюмируя содержательную часть конференции, отмечу:

- Использование Data Vault (Anchor Modeling — как опция) — золотой стандарт DWH.

- Тренд сегодняшнего дня — автоматизация [создания метаданных, генерации кода ETL, QA].

- Тренд завтрашнего дня — хранилище в облаке.

- Хорошее знание бизнеса — необходимое условие для построения хорошей модели.

Не хватало презентаций реальных проектов, рассказывающих о способах решения настоящих, а не гипотетических проблем, с которыми сталкиваются проектные команды при использовании красивых и стройных [на бумаге] методологий, об адаптации таких подходов к суровой прозе жизни.

Если говорить об общем впечатлении, основной эффект — мотивирующий. Мотивирующий к тому, чтобы почитать больше о представленных подходах. Мотивирующий заниматься этим достаточно востребованным делом. Пожалуй, аналитиков DWH с опытом до трех лет в первую очередь интересовали бы сами презентации, а их старшие товарищи-архитекторы нашли бы большее удовольствие в общении с коллегами «на полях». Лично мне удалось познакомиться с несколькими коллегами из Европы, Америки, и, как ни странно, России. Повезло пообщаться с некоторыми гуру. К слову, Ханс Хальтгрен в личной беседе сказал, что два русских парня, с которыми он работает в Долине — просто «amazing». И оставил автограф на своей, пожалуй, самой популярной книжке про Data Vault.