Вопросы к экзамену по ОТИ

|

Результаты |

Показатели |

Критерии |

|

У1 |

-выполнение |

-использование

— действительные

-соответствие

-применение |

|

У2 |

-перевод

-перевод

-перевод

-перевод |

-ход решения

-применение

-соответствие |

|

У3 |

-применение

-коды с обнаружением

-коды с исправлением

-вычисление

-вычисление

-вычисление веса

-введение

-исправление |

-применение

-применение

-построение

-применение

-выполнение

-определение

-инвертирование

-соответствие

— ход решения |

|

У4 |

-кодирование и

-кодирование и

-представление

-кодирование и

-кодирование и

-кодирование

-кодирование |

-соответствие

— ход решения

-перевод числа

-вычисление

-правильно выбрана

-правильный

-результаты |

|

У5 |

-применение

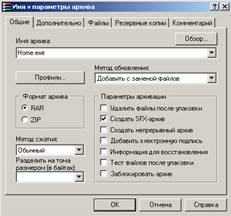

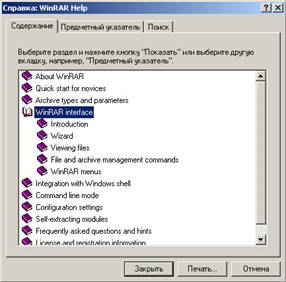

-архивирование

-умение |

-результат

-выполнено

-выполнено |

|

Знать: |

||

|

З1 |

— перечисление

-чтение кодовых

-знание формул

-определение

-представление

-знание формулы |

-полное перечисление

-правильное

-правильное

-описание принципов |

|

З2 |

-перечисление

-описание основных |

-полное перечисление

-воспроизведение

-воспроизведение

-правильное

-различение

-правильное |

|

З3 |

-перечисление |

-полное и правильное

-приведение |

|

З4 |

-перечисление |

-полное и правильное |

|

З5 |

-перечисление

— перечисление |

-полное и правильное |

|

З6 |

-понимание основ |

-полное и правильное |

|

З7 |

-перечисление |

-полное и правильное |

бюджетное

профессиональное образовательное учреждение

Вологодской области

«Сокольский лесопромышленный политехнический техникум»

УТВЕРЖДАЮ

И.о. директора БПОУ ВО

«Сокольский ЛПТ»

____________ Л.Н. Ломтева

«30» августа 2019 г.

КОМПЛЕКТ

КОНТРОЛЬНО — ОЦЕНОЧНЫХ СРЕДСТВ

по учебной

дисциплине

ОП.12. ОСНОВЫ ТЕОРИИ ИНФОРМАЦИИ

для специальности

09.02.06

Сетевое и системное администрирование

квалификация выпускника

СЕТЕВОЙ И СИСТЕМНЫЙ АДМИНИСТРАТОР

Сокол

2019

Комплект контрольно-оценочных средств разработан с

учетом требований Федерального государственного образовательного стандарта

среднего профессионального образования по специальности 09.02.06 Сетевое и

системное администрирование, на основе рабочей программы учебной дисциплины

ОП.12. Основы теории информации.

Разработчик:

Киренцова

Н.М., преподаватель БПОУ ВО «Сокольский ЛПТ»

Рассмотрено:

на заседании предметной

цикловой комиссии информационных и сетевых технологий «30» августа 2019г.,

протокол № 1

председатель

комиссии_________________ Н.А. Ефимова

(подпись)

СОГЛАСОВАНО:

|

Начальник отдела ИТ ПАО «Сокольский ЦБК» ____________Д.А. Киренцов «30» августа 2019 г. |

Начальник отдела ИТ ООО «Сухонский КБК» ____________М.А. Паншина «30» августа 2019 г. |

СОДЕРЖАНИЕ

1. Паспорт комплекта

контрольно-оценочных средств 4

2. Результаты освоения учебной

дисциплины, подлежащие проверке4

3. Оценка освоения учебной

дисциплины6

3.1. Формы и методы оценивания6

3.2. Задания для оценки освоения учебной

дисциплины9

4. Контрольно-оценочные

материалы для промежуточной

аттестации по учебной дисциплине

5. Лист согласования 122

1.

ПАСПОРТ КОМПЛЕКТА

КОНТРОЛЬНО-ОЦЕНОЧНЫХ СРЕДСТВ

Контрольно-оценочные средства (КОС)

предназначены для контроля и оценки образовательных достижений студентов,

освоивших программу учебной дисциплины ОП.12. Основы теории информации.

КОС включают контрольные материалы для

проведения текущего контроля и промежуточной аттестации в форме экзамена.

2. РЕЗУЛЬТАТЫ ОСВОЕНИЯ УЧЕБНОЙ ДИСЦИПЛИНЫ, ПОДЛЕЖАЩИЕ

ПРОВЕРКЕ

В результате аттестации по учебной дисциплине

осуществляется комплексная проверка следующих умений и знаний, а также динамика

формирования общих компетенций.

В результате освоения учебной дисциплины ОП.12. Основы

теории информации студент должен обладать предусмотренными ФГОС по

специальности СПО 09.02.06 Сетевое и системное администрирование следующими

умениями, знаниями, которые формируют профессиональные компетенции, и общими компетенциями:

ОК 01.

Выбирать способы решения задач профессиональной деятельности, применительно к

различным контекстам.

ОК 02.

Осуществлять поиск, анализ и интерпретацию информации, необходимой для

выполнения задач профессиональной деятельности.

ОК 04.

Работать в коллективе и команде, эффективно взаимодействовать с коллегами,

руководством, клиентами.

ОК 05.

Осуществлять устную и письменную коммуникацию на государственном языке с учетом

особенностей социального и культурного контекста.

ОК 09.

Использовать информационные технологии в профессиональной деятельности.

ОК 10.

Пользоваться профессиональной документацией на государственном и иностранном

языках.

Умения:

У1 Применять закон аддитивной информации.

У2 Применять теорему Котельникова.

У3 Использовать формулу Шеннона.

Знания:

З1. Виды и формы представления информации;

З2. Методы и средства определения количества

информации;

З3. Принципы кодирования и декодирования

информации;

З4. Способы

передачи цифровой информации;

З5. Методы повышения помехозащищенности передачи и приема

данных, основы теории сжатия данных

З6. Методы криптографической защиты информации

З7. Способы генерации ключей

Содержание дисциплины ориентировано на подготовку

студентов к овладению профессиональными компетенциями (ПК):

ПК 1.3. Обеспечивать защиту информации

в сети с использованием программно-аппаратных средств.

Формой промежуточной аттестации по учебной дисциплине

является экзамен.

3. ОЦЕНКА

ОСВОЕНИЯ УЧЕБНОЙ ДИСЦИПЛИНЫ

3.1.

Формы и методы контроля

Контроль и оценка освоения учебной дисциплины по темам

|

Элемент учебной дисциплины |

Формы и методы контроля |

||||||

|

Текущий контроль |

Промежуточная аттестация |

||||||

|

Форма контроля |

Самостоятельная работа |

Проверяемые ОК, У, З |

Форма контроля |

Проверяемые ОК, У, З |

|||

|

Раздел 1. Базовые понятия теории информации |

Устный опрос по теме «Формальное Устный опрос по теме «Способы Устный опрос по теме Проверочная работа Практическая работа «Способы хранения обработки и передачи информации» Практическая |

Информация в материальном мире, Дисперсия случайной величины |

ОК 01, ОК 02, ОК 04, ОК 05, ОК 09, ОК 10,, З1, З2, З3, З4 |

Экзамен |

ОК 01, ОК 02, ОК 04, ОК 05, ОК 09, ОК 10,, З1, З2, З3, З4 |

||

|

Раздел 2. Информация и энтропия |

Устный опрос по теме «Теорема Устный опрос по теме «Понятие Устный опрос по теме «Смысл Практическая Практическая работа «Определение пропускной способности канала» Практическая работа «Интерполяционная Практическая работа «Поиск Практическая работа «Энтропийное Практическая работа «Дифференциальная Практическая |

Математическая модель системы b-арная энтропия, взаимная энтропия Закон аддитивности информации |

ОК 01, ОК 02, ОК 04, ОК 05, ОК 09, ОК 10, У1, У2, У3, З3, З4, З5 |

Экзамен |

ОК 01, ОК 02, ОК 04, ОК 05, ОК 09, ОК 10, У1, У2, У3, З3, З4, З5 |

|

Раздел 3. Защиты и передача информации |

Устный опрос по теме «Сжатие Тест на тему «Сжатие информации» Устный опрос по теме «Кодирование» Тест «Кодирование информации» Практическая работа «ПУ кодирование» Практическая работа «Адаптивное арифметическое кодирование. Дельта-кодирование» Практическая |

Применение алгоритмов кодирования в Дельта-кодирование |

ОК 01, ОК 02, ОК 04, ОК 05, ОК 09, ОК 10, З5, У3 |

Экзамен |

ОК 01, ОК 02, ОК 04, ОК 05, ОК 09, ОК 10, З5, У3 |

|

Раздел 4. Основы теории защиты информации |

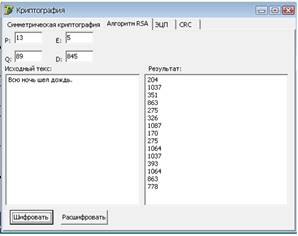

Устный опрос по теме «Стандарты Тест по теме «Криптография» Практическая работа «Практическое применение криптографии. Изучение и Практическая работа «Криптография Практическая работа «Шифрование с Практическая работа «Шифрование с Практическая работа «Практическое применение различных алгоритмов Сравнение и анализ |

Различные методы шифрования |

ОК 01, ОК 02, ОК 04, ОК 05, ОК 09, ОК 10, У3, З5, З6, З7 |

Экзамен |

ОК 01, ОК 02, ОК 04, ОК 05, ОК 09, ОК 10, У3, З5, З6, З7 |

3.2. ЗАДАНИЯ ДЛЯ ОЦЕНКИ ОСВОЕНИЯ

УЧЕБНОЙ ДИСЦИПЛИНЫ

РАЗДЕЛ 1. БАЗОВЫЕ ПОНЯТИЯ ТЕОРИИ ИНФОРМАЦИИ

УСТНЫЙ ОПРОС ПО ТЕМЕ

«ФОРМАЛЬНОЕ ПРЕДСТАВЛЕНИЕ ЗНАНИЙ. ВИДЫ ИНФОРМАЦИИ»

Вопросы:

- Понятие

теории информации. - Формальное

представление данных. - Виды

информации.

Критерии

оценки устного ответа:

«5

(отлично)»: ответ полный и правильный

на основании изученных теорий; материал изложен в определенной логической

последовательности, литературным языком: ответ самостоятельный.

«4

(хорошо)»: ответ полный и правильный

на основании изученных теорий; материал изложен в определенной логической

последовательности, при этом допущены две-три несущественные ошибки,

исправленные по требованию преподавателя.

«3

(удовлетворительно)»: ответ полный,

но при этом допущена существенная ошибка, или неполный, несвязный.

«2

(неудовлетворительно)»: при ответе

обнаружено непонимание студентом основного содержания учебного материала или

допущены существенные ошибки, которые студент не смог исправить при наводящих

вопросах преподавателя.

УСТНЫЙ ОПРОС ПО ТЕМЕ

«СПОСОБЫ ИЗМЕРЕНИЯ ИНФОРМАЦИИ»

Вопросы:

- Базовые

понятия теории информации. - Способы

измерения информации.

Критерии

оценки устного ответа:

«5

(отлично)»: ответ полный и правильный

на основании изученных теорий; материал изложен в определенной логической

последовательности, литературным языком: ответ самостоятельный.

«4

(хорошо)»: ответ полный и правильный

на основании изученных теорий; материал изложен в определенной логической

последовательности, при этом допущены две-три несущественные ошибки,

исправленные по требованию преподавателя.

«3

(удовлетворительно)»: ответ полный,

но при этом допущена существенная ошибка, или неполный, несвязный.

«2

(неудовлетворительно)»: при ответе

обнаружено непонимание студентом основного содержания учебного материала или

допущены существенные ошибки, которые студент не смог исправить при наводящих

вопросах преподавателя.

УСТНЫЙ ОПРОС ПО ТЕМЕ

«ВЕРОЯТНОСТНЫЙ ПОДХОД К ИЗМЕРЕНИЮ

ИНФОРМАЦИИ»

Вопросы:

- Вероятностный

подход к измерению информации. - Решение

упражнений по данной теме.

Критерии

оценки устного ответа:

«5

(отлично)»: ответ полный и правильный

на основании изученных теорий; материал изложен в определенной логической

последовательности, литературным языком: ответ самостоятельный.

«4

(хорошо)»: ответ полный и правильный

на основании изученных теорий; материал изложен в определенной логической

последовательности, при этом допущены две-три несущественные ошибки,

исправленные по требованию преподавателя.

«3

(удовлетворительно)»: ответ полный,

но при этом допущена существенная ошибка, или неполный, несвязный.

«2

(неудовлетворительно)»: при ответе

обнаружено непонимание студентом основного содержания учебного материала или

допущены существенные ошибки, которые студент не смог исправить при наводящих

вопросах преподавателя.

ПРОВЕРОЧНАЯ РАБОТА (ТЕСТ) ПО ТЕМЕ

«БАЗОВЫЕ ПОНЯТИЯ ТЕОРИИ ИНФОРМАЦИИ»

Вариант 1

Выберите правильный вариант ответа:

1)

Информацию, изложенную на доступном для

получателя языке, называют…

a)

понятной;

b)

актуальной;

c)

достоверной;

d)

полной.

2)

Наибольший объем информации человек

получает при помощи…

a)

вкусовых рецепторов;

b)

органов осязания;

c)

органов зрения;

d)

органов слуха;

e)

органов обоняния.

3)

К формальным языкам можно отнести…

a)

язык программирования;

b)

русский язык;

c)

китайский язык;

d)

язык жестов.

4)

Материальный объект, предназначенный

для хранения информации, называется…

a)

носитель информации;

b)

получатель информации;

c)

хранитель информации;

d)

канал связи.

5)

Сообщение, уменьшающее неопределенность

знаний в два раза, несет…

a)

1 бит;

b)

4 бита;

c)

1 байт;

d)

2 бита.

6)

Алфавит языка состоит из 16 знаков.

Сколько информации несет сообщение длиной 32 символа?

a)

16 бит;

b)

128 бит;

c)

256 бит;

d)

80 бит.

7)

Сколько байт в словах «информационные

технологии» (без учета кавычек)?

a)

24 байта;

b)

192 байт;

c)

25 байт;

d)

2 байта.

Сколько байт в 4 Мбайт?

a)

4000;

b)

222;

c)

212;

d)

420.

9)

В какой из последовательностей единицы

измерения указаны в порядке возрастания

a)

мегабайт, килобайт, байт, гигабайт;

b)

байт, килобайт, мегабайт, гигабайт;

c)

гигабайт, килобайт, мегабайт, байт;

d)

гигабайт, мегабайт, килобайт, байт.

10)

Процесс представления информации

(сообщения) в виде кода называется…

a)

декодированием;

b)

дешифрованием;

c)

кодированием;

d)

дискретизацией.

11)

Является ли верным утверждение: «В

позиционной системе счисления количественный эквивалент цифры зависит от места

цифры в записи числа»?

12)

Алфавит системы счисления 0, 1, 2, 3,

4, 5. Какая это система счисления?

a)

шестеричная;

b)

пятеричная;

c)

восьмеричная;

d)

римская.

13)

Двоичное число 10012 соответствует десятичному числу…

a)

100110;

b)

610;

c)

910;

d)

810.

14)

Найти двоичный эквивалент числа Х, представленного в десятичной системе

счисления,

если Х = 5.

a) 1102;

b) 1012;

c) 10012;

d) 112.

15)

Укажите самое большое число.

a)

14416;

b)

14410;

c)

1446;

d)

1448.

a)

111111112;

b)

3778;

c)

FF16;

d)

22610.

17)

Сложите числа 5А16+438+1112+510,

результат получите в двоичной системе счисления.

a)

111100012;

b)

100000112;

c)

100010012;

d)

100111012.

18)

Пусть небольшая книжка, сделанная с

помощью компьютера, содержит 15 страниц; на каждой странице — 40 строк, в

каждой строке — 60 символов. Сколько информации она содержит?

a)

36000 байт;

b)

19200 байт;

c)

256 бит;

d)

2400 байт

19)

Изображение представляющее собой

совокупность точек (пикселей) разных цветов называется…

a)

векторным;

b)

цветным;

c)

аналоговым;

d)

растровым.

20)

Многопроходная линия для

информационного обмена между устройствами компьютера называется…

a)

модемом;

b)

контроллером;

c)

магистралью;

d)

провайдером.

21)

Устройством вода информации является…

a)

сканер;

b)

дисковод;

c)

принтер;

d)

клавиатура.

22)

Комплекс взаимосвязанных программ,

обеспечивающий пользователю удобный способ общения с программами, называется…

a)

утилитой;

b)

драйвером;

c)

интерпретатором;

d)

интерфейсом.

23)

Расширение имени файла характеризует…

a)

время создания файла;

b)

тип информации, содержащейся в файле;

c)

объем файла;

d)

место, занимаемое файлом на диске.

24)

Архивный файл представляет собой…

a)

файл, которым долго не пользовались;

b)

файл, защищенный от

несанкционированного доступа;

c)

файл, защищенный от копирования;

d)

файл, сжатый с помощью архиватора.

25)

По среде обитания компьютерные вирусы

классифицируют на…

a)

неопасные, опасные и очень опасные;

b)

паразиты, репликаторы, невидимки,

мутанты, троянские;

c)

сетевые, файловые, загрузочные,

макровирусы.

26)

К антивирусным программам не

относятся…

a)

интерпретаторы;

b)

фаги;

c)

ревизоры;

d)

сторожа.

27)

В каком году появилась первая ЭВМ?

a)

1823;

b)

1951;

c)

1980;

d)

1905.

28)

На какой электронной основе созданы ЭВМ

I

поколения?

a)

транзисторы;

b)

электронно-вакуумные лампы;

c)

зубчатые колеса;

d)

реле.

Вариант 2

Выберите правильный вариант ответа:

1)

Информацию, отражающую истинное

положение вещей, называют…

a)

актуальной;

b)

понятной;

c)

полезной;

d)

достоверной.

2)

Тактильную информацию человек получает

посредством…

a)

специальных приборов;

b)

органов слуха;

c)

термометра;

d)

органов осязания.

3)

К естественным языкам можно отнести…

a)

язык программирования;

b)

английский язык;

c)

язык математики;

d)

язык химических формул.

4)

Информация в компьютере хранится,

передается и обрабатывается в виде…

a)

знаков и импульсов;

b)

сигналов и импульсов;

c)

импульсов;

d)

символов.

5)

Если сообщение несет 1 бит информации,

то оно уменьшает неопределенность знаний…

a)

в два раза;

b)

в один раз;

c)

в три раза;

d)

на 8 бит.

6)

В зоопарке 64 клетки, тигр сидит в

клетке номер 16. Сколько информации несет это сообщение?

a)

16 бит;

b)

256 бит;

c)

6 бит;

d)

64 бита.

7)

Сколько байт в словосочетании «Системы

счисления» (без учета кавычек)?

a)

17 байт;

b)

2 бита;

c)

8 бит;

d)

136 бит.

a)

1024 байт;

b)

210 бит;

c)

230 байт;

d)

1000 бит.

9)

В какой из последовательностей единицы

измерения указаны в порядке убывания.

a)

гигабайт, мегабайт, килобайт, байт;

b)

мегабайт, килобайт, байт, гигабайт;

c)

гигабайт, килобайт, мегабайт, байт;

d)

байт, килобайт, мегабайт, гигабайт.

10) Процесс преобразования кода к форме исходной символьной

системы, т.е. получение исходного сообщения называется…

a)

декодированием;

b)

кодированием;

c)

шифрованием;

d)

дискретизацией.

11) Для какого класса

систем счисления выполняется условие: количественный эквивалент цифры не

зависит от места цифры в записи числа?

a) для

позиционного;

b) для

непозиционного.

12) Алфавит системы счисления 0, 1, 2, 3, 4, 5, 6. Какая это

система счисления?

a)

восьмеричная;

b)

семеричная;

c)

римская;

d)

шестеричная.

13) Двоичное число 11002 соответствует десятичному числу…

a)

1110;

b)

1210;

c)

910;

d)

110010.

14) Найти

двоичный эквивалент числа Х, представленного в десятичной системе счисления,

если Х = 6.

a)

111;

b)

11;

c)

011;

d)

110.

15) Укажите самое маленькое число.

a)

14416

e)

14410

f)

1446

g)

1448

a)

101011112

b)

2568

c)

АF16

d)

17510

17) Сложите числа А516+238+1012+1010,

результат получите в двоичной системе счисления.

a)

11000111;

b)

11101000;

c)

10000001;

d)

10000011.

18) Сколько информации содержит лист текста, сделанный с

помощью компьютера, если на странице — 30 строк, в каждой строке — 50 символов?

a)

16 Кбит;

b)

256 бит;

c)

1500 бит;

d)

12000 бит.

19) Минимальный участок изображения, цвет которого можно задать

независимым образом называется…

a)

бит;

b)

пиксель;

c)

примитив;

d)

растр.

20)

Во время исполнения прикладная

программа хранится…

a)

в видеопамяти;

b)

в процессоре;

c)

на жестком диске;

d)

в оперативной памяти.

21)

Устройство для подключения компьютера к

сети Интернет, называется…

a)

модем;

b)

факс;

c)

плоттер;

d)

браузер.

22) Программа, позволяющая

управлять внешним устройством компьютера, называется …

a) браузером;

b) драйвером;

c) операционная

система;

d) система

программирования.

23) Исполняемые файлы имеют расширение…

a)

doc, txt;

b)

txt, sys;

c)

sys, exe;

d)

com, exe.

24) Программа для уменьшения информационного объема (сжатия)

файлов, называется …

a)

утилитой;

b)

драйвером;

c)

архиватором;

d)

компилятором.

25) Компьютерные программы-вирусы…

a)

возникают в результате сбоев в

аппаратных средствах компьютерах;

b)

пишутся специально для нанесения ущерба

пользователям ПК;

c)

имеют биологическое происхождение;

d)

являются следствием ошибок в

операционной системе.

26) Вирусы поражающие загрузочные секторы дисков, называются…

a)

загрузчиками;

b)

файловыми;

c)

загрузочными;

d)

сетевыми.

27) Кого называют первой в истории женщиной-программистом:

a)

Софью Ковалевскую;

b)

Марию Склодовскую-Кюри;

c)

Аду Лавлейс.

28) Сколько поколений ЭВМ принято считать созданными до нашего

времени?

a)

три;

b)

четыре;

c)

шесть;

d)

два.

Вариант 3

Выберите правильный вариант ответа:

29) Информацию, существенную и важную в настоящий момент,

называют:

a)

понятной;

b)

полезной;

c)

достоверной;

d)

актуальной.

30) По форме представления информация подразделяется на…

a)

книжную, газетную, компьютерную;

b)

текстовую, числовую, графическую, звуковую;

c)

тактильную, вкусовую, обонятельную,

осязательную, визуальную, звуковую;

d)

массовую, личную, специальную.

31) В общей схеме передачи информации между источником и

приемником информации должен существовать…

a)

канал связи;

b)

электрическое поле;

c)

воздух;

d)

линия связи.

32) Книги, картины, дискеты позволяют информацию в основном…

a)

передавать и обрабатывать;

b)

обрабатывать и хранить;

c)

хранить и передавать;

d)

запоминать.

33) Если сообщение несет 2 бита информации, то оно уменьшает

неопределенность знаний…

a)

в два раза;

b)

в четыре раза;

c)

в три раза;

d)

на 8 бит.

34) В доме 32 квартиры, день рождения справляют в квартире номер

10. Сколько информации несет это сообщение?

a)

10 байт;

b)

5 бит;

c)

64 бита;

d)

4 бита.

35) Сколько байт в словосочетании «Тактильная информация» (без

учета кавычек)?

a)

25 байт;

b)

5 байт;

c)

21 байт;

d)

2 байта.

a)

1024 байт;

b)

210 бит;

c)

230 байт;

d)

10000 бит.

37) Минимальной единицей измерения информации является…

a)

1 гигабайт;

b)

1 бод;

c)

1 байт;

d)

1 бит.

38) Сигнал, принимающий лишь конечное число значений,

называется…

a)

аналоговым;

b)

частично дискретный;

c)

дискретны;

d)

частично аналоговый.

39) В какой системе

счисления представлена информация, хранящаяся в компьютере?

a) в

троичной;

b) в

десятичной;

c) в

двоичной;

d) в

римской.

40) Какое количество цифр используется в восьмеричной системе

счисления?

41) Двоичное число 1012 соответствует десятичному числу

a)

610;

b)

1010;

c)

10110;

d)

510.

42) Найдите двоичный эквивалент числа Х, представленного в

десятичной системе счисления, если Х=8.

a)

1000;

b)

1001;

c)

1010;

d)

1110.

43) Укажите самое маленькое число.

a)

11116

h)

11110

i)

1116

j)

1118

a)

101012

b)

268

c)

1516

d)

2110

45) Сложите числа А916+158+1102+1110,

результат получите в двоичной системе счисления.

a)

11001000;

b)

11111110;

c)

10000001;

d)

11100100.

46) Сколько информации содержит лист текста, сделанный с

помощью компьютера, если на странице — 30 строк, в каждой строке — 40 символов?

a)

16 Кбит;

b)

9600 бит;

c)

1200 бит;

d)

256бит.

47) Какие изображения формируются из графических примитивов

(линий, окружностей, прямоугольников и т.д.)

a)

векторные;

b)

растровые.

48) К внешним запоминающим устройствам относится…

a)

процессор;

b)

монитор;

c)

CD-диск;

d)

клавиатура.

49) Укажите устройства ввода.

a)

принтер, клавиатура, джойстик;

b)

графический планшет, клавиатура,

сканер;

c)

мышь, световое перо, винчестер;

d)

телефакс, модем, принтер.

50) Совокупность программ, обеспечивающих совместное

функционирование всех устройств компьютера и предоставляющих пользователю

доступ к ресурсам компьютера, называется…

a)

утилитой;

b)

драйвером;

c)

операционной системой;

d)

интерфейсом.

51) Укажите тип файлов со следующими расширениями: *.txt, *.doc.

a)

исполнимые файлы;

b)

графические файлы;

c)

текстовые файлы.

d)

звуковые файлы.

52) Архивный файл отличается от исходного файла тем, что…

a)

доступ к нему занимает меньше времени;

b)

легче защищать от вирусов;

c)

более удобен для редактирования;

d)

занимает меньше места на диске.

53) Отличительными особенностями компьютерного вируса являются…

a)

легкость распознавания и уничтожения;

b)

способность к самокопированию и

самостоятельному запуску;

c)

значительный объем программного кода;

d)

трудность распознавания и уничтожения.

54) Вирус, заражение которым может произойти при работе с

электронной почтой, называется…

a)

файловым;

b)

макровирусом;

c)

сетевым;

d)

загрузочные.

55) Когда был создан первый арифмометр – механическое счетное

устройство?

a)

в XIX веке;

b)

в XX веке;

c)

в XIV веке.

56) Электронной базой ЭВМ III поколения является…

a)

транзисторы;

b)

БИС;

c)

электронно-вакуумные лампы;

d)

интегральные схемы.

Вариант 4

Выберите

правильный вариант ответа:

29)

Информацию, не зависящую от личного

мнения или суждения, называют:

a)

объективной;

b)

актуальной;

c)

достоверной;

d)

понятной.

30)

Визуальной называют информацию, которая

воспринимается человеком посредством…

a)

вкусовых рецепторов;

b)

органов осязания;

c)

органов зрения;

d)

органов слуха;

e)

органов обоняния.

31)

Язык программирования относится к…

a)

формальным языкам;

b)

естественным языкам.

32)

Носителем графической информации не

может являться…

a)

дискета;

b)

грампластинка;

c)

холст;

d)

бумага.

33)

Сообщение, уменьшающее неопределенность

знаний в 4 раза, несет

a)

2 бита информации;

b)

4 бита информации;

c)

16 бит информации;

d)

1 байт информации.

34)

Алфавит языка состоит из 32 знака.

Сколько информации несет сообщение длиной 16 символа?

a)

16 бит;

b)

128 бит;

c)

256 бит;

d)

80 бит.

35)

Сколько бит в слове «моделирование»

(без учета кавычек)?

a)

13 бит;

b)

104 бит;

c)

12 бит;

d)

2 бита.

36)

Сколько бит в 1 Кбайте?

a)

1024;

b)

213 ;

c)

1000;

d)

210 .

37)

В какой из последовательностей единицы

измерения указаны в порядке возрастания

a)

мегабайт, килобайт, байт, гигабайт;

b)

байт, килобайт, мегабайт, гигабайт;

c)

гигабайт, килобайт, мегабайт, байт;

d)

гигабайт, мегабайт, килобайт, байт.

38)

Преобразование непрерывных изображений

и звука в набор дискретных значений в форме кодов называют…

a)

декодированием;

b)

дешифрованием;

c)

кодированием;

d)

дискретизацией.

39)

Система счисления — это …

a) совокупность цифр;

b) совокупность

цифр 0, 1;

c) совокупность цифр I, V, X, L, C,

D, M;

d) способ

записи чисел с помощью заданного набора специальных знаков (цифр).

40)

Какое количество цифр используется в шестнадцатеричной системе

счисления?

a)

16;

b)

15;

c)

6;

d)

8.

41)

Двоичное число 11012 соответствует десятичному числу

a)

110110;

b)

1310;

c)

1010;

d)

810.

42)

Найти двоичный эквивалент числа Х, представленного в десятичной системе

счисления,

если Х = 7.

a) 110;

b) 101;

c) 111;

d) 1001.

43)

Укажите самое большое число.

a)

2516

b)

2510

c)

256

d)

258

a)

101010012

b)

2538

c)

AB16

d)

17110

45)

Сложите числа А416+368+1102+1010,

результат получите в двоичной системе счисления.

a)

11110011;

b)

11010010;

c)

10010010;

d)

11000110.

46)

Пусть небольшая книжка, сделанная с

помощью компьютера, содержит 5 страниц; на каждой странице — 120 строк, в

каждой строке — 60 символов. Сколько информации она содержит?

a)

36000 байт;

b)

19200 байт;

c)

256 бит;

d)

2400 байт

47)

Количество информации, которое

используется для кодирования цвета точки изображения, называется…

a)

палитрой;

b)

разрешающей способностью;

c)

глубиной цвета;

d)

дискретизацией.

48) Системный диск необходим для…

a)

хранения архивных файлов;

b)

систематизации файлов;

c)

лечения компьютера от вирусов;

d)

загрузки операционной системы.

49) Дисковод – это устройство, предназначенное для …

a)

чтения/записи данных с внешнего

носителя.

b)

хранения компакт-дисков;

c)

долговременного хранения информации;

d)

вывода информации на внешний носитель;

50) Процесс, в результате которого файлы записываются в

секторы, последовательно идущие друг за другом, называется…

a)

дефрагментацией;

b)

форматированием;

c)

архивацией;

d)

копированием.

51) Порядок хранения файлов на диске определяется используемой

…

a)

операционной системой;

b)

файловой системой.

52) Укажите расширение для архивных файлов.

a)

*.rar, *.zip;

b)

*.bmp, ipg;

c)

mp3, wav.

53) Заражение компьютерным вирусом может произойти в процессе…

a)

печати на принтере;

b)

работы с файлами;

c)

форматирования дискеты;

d)

при выключении компьютера.

54) Какие типы файлов может заразить макровирус?

a)

графические файлы;

b)

звуковые и видеофайлы;

c)

текстовые файлы с расширением doc.

55) На какой электронной основе созданы ЭВМ II поколения?

a)

транзисторы;

b)

электронно-вакуумные лампы;

c)

реле;

d)

БИС.

56) Какой фирмой и в каком году были созданы первые

персональные компьютеры?

a)

IBM в 1991 году;

b)

Apple в 1982 году;

c)

IBM в 1982 году;

d)

Apple в 1990 году.

Ответы к тестовым

заданиям. I вариант.

|

1. |

2. |

3. |

4. |

5. |

6. |

7. |

8. |

9. |

10. |

11. |

12. |

13. |

14. |

|

а |

с |

а |

а |

а |

b |

c |

b |

b |

c |

a |

a |

c |

b |

|

15. |

16. |

17. |

18. |

19. |

20. |

21. |

22. |

23. |

24. |

25. |

26. |

27. |

28. |

|

a |

d |

c |

a |

d |

c |

d |

d |

b |

d |

c |

a |

b |

b |

Ответы к тестовым

заданиям. II вариант.

|

1. |

2. |

3. |

4. |

5. |

6. |

7. |

8. |

9. |

10. |

11. |

12. |

13. |

14. |

|

d |

d |

b |

c |

a |

c |

a |

a |

a |

b |

b |

b |

b |

d |

|

15. |

16. |

17. |

18. |

19. |

20. |

21. |

22. |

23. |

24. |

25. |

26. |

27. |

28. |

|

b |

b |

a |

d |

b |

d |

a |

b |

d |

c |

b |

c |

c |

b |

Ответы к тестовым заданиям. III вариант.

|

1. |

2. |

3. |

4. |

5. |

6. |

7. |

8. |

9. |

10. |

11. |

12. |

13. |

14. |

|

d |

b |

a |

c |

b |

b |

c |

c |

d |

c |

c |

b |

d |

a |

|

15. |

16. |

17. |

18. |

19. |

20. |

21. |

22. |

23. |

24. |

25. |

26. |

27. |

28. |

|

b |

b |

a |

b |

a |

c |

b |

c |

c |

d |

b |

c |

a |

d |

Ответы к тестовым

заданиям. IV вариант.

|

1. |

2. |

3. |

4. |

5. |

6. |

7. |

8. |

9. |

10. |

11. |

12. |

13. |

14. |

|

a |

c |

a |

b |

c |

d |

b |

b |

b |

d |

d |

a |

b |

c |

|

15. |

16. |

17. |

18. |

19. |

20. |

21. |

22. |

23. |

24. |

25. |

26. |

27. |

28. |

|

a |

d |

b |

a |

c |

d |

a |

a |

b |

a |

b |

c |

a |

c |

Критерии

оценивания теста:

5

(отлично) – правильно выполнены 27-28

заданий.

4

(хорошо) – правильно выполнены 21-26

задания.

3

(удовлетворительно) – правильно

выполнены 15-20 заданий.

2

(неудовлетворительно) – правильно

выполнены менее 15 заданий.

ПРАКТИЧЕСКАЯ РАБОТА

«ИЗМЕРЕНИЕ

КОЛИЧЕСТВА ИНФОРМАЦИИ».

1

ВАРИАНТ

|

Задание №1. Заполните |

||||||

|

1 |

5 Кбайт = |

байт = |

бит |

|||

|

2 |

12 Кбайт = |

байт = |

бит |

|||

|

3 |

107 Гбайт= |

Мбайт = |

Кбайт |

|

Задание № 2. Решите |

||||||||

|

1 |

Сообщение занимает 3 |

|||||||

|

Ответ: |

символов |

|||||||

|

2 |

Для записи сообщения |

|||||||

|

Ответ: |

байта |

|||||||

|

3 |

Емкость одной дискеты |

|||||||

|

Ответ: |

дискет(-а) |

2

ВАРИАНТ

|

Задание №1. Заполните |

||||||

|

1 |

Кбайт = |

байт = |

12288 бит |

|||

|

2 |

6 Кбайт = |

байт |

||||

|

3 |

5242880 Кб= |

Гбайт |

|

Задание № 2. Решите |

||||||||

|

1 |

Для передачи сообщения |

|||||||

|

Ответ: |

Килобайт |

(ответ округлите до двух |

||||||

|

2 |

Какова мощность алфавита, |

|||||||

|

Ответ: |

символов |

|||||||

|

3 |

Измерьте информационный |

|||||||

|

Ответ: |

бит |

|||||||

|

байт |

||||||||

|

Кбайт |

(ответ округлите до двух |

3

ВАРИАНТ

|

Задание №1. Заполните |

||||||

|

1 |

Кбайт = |

байт = |

8192 бит |

|||

|

2 |

Гбайт = |

1536 Мб = |

Кбайт |

|||

|

3 |

94 Мбайта = |

Кбайт |

|

Задание № 2. Решите |

||||||||

|

1 |

Для записи сообщения |

|||||||

|

Ответ: |

байта |

|||||||

|

2 |

Измерьте информационный |

|||||||

|

Ответ: |

бит |

|||||||

|

байт |

||||||||

|

Кбайт |

(ответ округлите до двух |

|||||||

|

3 |

Емкость одной дискеты |

|||||||

|

Ответ: |

дискет(-а) |

Критерии

оценки практической работы:

5 (отлично) – правильно решены все 6 задач.

4 (хорошо) – не правильно решены 1 задача из 1 задания или 1

задача из 2 задания.

3 (удовлетворительно) – неправильно решены 2 задачи.

2 (неудовлетворительно) – неправильно решено более 3 задач.

ОТВЕТЫ:

|

Задание №1. Заполните |

||||||

|

5 Кбайт = |

5120 |

байт = |

40960 |

бит |

||

|

1,5 |

Кбайт = |

1536 |

байт = |

12288 бит |

||

|

1 |

Кбайт = |

1024 |

байт = |

8192 бит |

||

|

1,5 |

Гбайт = |

1536 Мб = |

1572864 |

Кбайт |

||

|

12 Кбайт = |

12288 |

байт = |

98304 |

бит |

||

|

6 Кбайт = |

6144 |

байт |

||||

|

94 Мбайта = |

96256 |

Кбайт |

||||

|

107 Гбайт= |

109568 |

Мбайт = |

112197632 |

Кбайт |

||

|

5242880 Кб= |

5 |

Гбайт |

|

Задание № 2. Решите |

|||||||||

|

Для передачи сообщения |

|||||||||

|

Ответ: |

35,16 |

Килобайт |

(Ответ округлите до двух |

||||||

|

Сообщение занимает 3 |

|||||||||

|

Ответ: |

4 |

символов |

|||||||

|

Для записи сообщения |

|||||||||

|

Ответ: |

4200 |

байта |

|||||||

|

Какова мощность алфавита, |

|||||||||

|

Ответ: |

256 |

символов |

|||||||

|

Измерьте информационный |

|||||||||

|

Ответ: |

288 |

бит |

|||||||

|

36 |

байт |

||||||||

|

0,04 |

Кбайт |

(округлите до двух |

|||||||

|

Емкость одной дискеты |

|||||||||

|

Ответ: |

451 |

дискет(-а) |

ПРАКТИЧЕСКАЯ РАБОТА

«СПОСОБЫ ХРАНЕНИЯ ОБРАБОТКИ И ПЕРЕДАЧИ ИНФОРМАЦИИ»

Цель:

научиться сохранять, обрабатывать и передавать данные при помощи технических

средств информации.

Время

выполнения: 2 часа

Оборудование:

ПК, сканер, фотоаппарат, микрофон, диск.

Раздаточный

материал: инструкционно – технологическая карта для сканирования фотографии.

Программное

обеспечение: операционная система, программа для работы с видеоинформацией.

Теоретические

основы

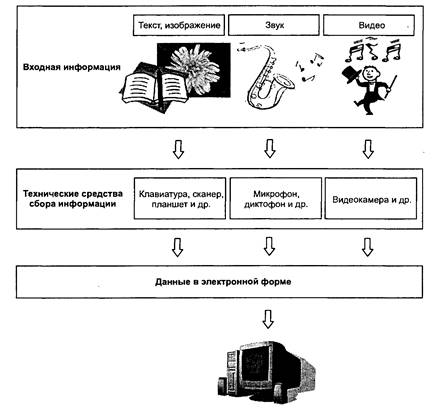

1. Технологии сбора и хранения информации

Сбор предполагает

получение максимально выверенной исходной информации и является одним из самых

ответственных этапов в работе с информацией, поскольку от цели сбора и методов

последующей обработки полностью зависит конечный результат работы всей

информационной системы.

Технология сбора

подразумевает использование определенных методов сбора информации и технических

средств, выбираемых в зависимости от вида информации и применяемых методов ее

сбора. На заключительном этапе сбора, когда информация преобразуется в данные,

т. е. в информацию, представленную в формализованном виде, пригодном для компьютерной

обработки, осуществляется ее ввод в систему Для

сбора данных необходимо сначала определить технические средства, позволяющие

осуществлять сбор быстро и высококачественно и поддерживающие операции ввода

информации и представления данных в электронной форме.

2. Технологический процесс обработки информации

Технологический процесс обработки

информации — есть строго определенная последовательность взаимосвязанных

процедур, выполняемых для преобразования первичной информации с момента ее

возникновения до получения требуемого результата.

Технологический процесс призван автоматизировать обработку

исходной информации за счет привлечения технических средств базовой

информационной технологии, сократить финансовые и трудовые затраты, обеспечить

высокую степень достоверности результатной информации. Для конкретной задачи

той или иной предметной области технологический процесс обработки информации

разрабатывается индивидуально. Совокупность процедур зависит от следующих

факторов:

• характер и сложность решаемой задачи;

• алгоритм преобразования информации;

• используемые технические средства;

• сроки обработки данных;

• используемые системы контроля;

• число пользователей и т. д.

В общем случае технологический процесс обработки информации включает

процедуры.

3. Способы обработки информации

Современные

информационные технологии позволяют обрабатывать информацию централизованным и

децентрализованным (т. е. распределенным) способами.

Централизованный способ

предполагает сосредоточение данных в информационно-вычислительном центре,

выполняющем все основные действия технологического процесса обработки

информации. Основное достоинство централизованного способа — сравнительная

дешевизна обработки больших объемов информации за счет повышения загрузки

вычислительных средств.

Децентрализованный способ

характеризуется рассредоточением информационно-вычислительных ресурсов и

распределением технологического процесса обработки информации по местам

возникновения и потребления информации. Достоинством децентрализованного

способа является повышение оперативности обработки информации и решения

поставленных задач за счет автоматизации деятельности на конкретных рабочих

местах, применения надежных средств передачи информации, организации сбора

первичных документов и ввода исходных данных в местах их возникновения.

Децентрализованный

способ обработки информации может быть реализован автономным или сетевым

методом. При автономной обработке информации передача документов и данных на

электронных носителях осуществляется по почте либо курьером, а при сетевой —

через современные каналы связи.

На практике применяют

смешанный способ обработки информации, для которого характерны признаки двух

способов одновременно (централизованный с частичной децентрализацией или децентрализованный

с частичной централизацией).

4. Режимы обработки

информации на компьютере

Вычислительные средства

участвуют в процессе обработки информации в двух основных режимах: пакетном или

диалоговом.

В случае,

когда технология обработки информации на компьютере представляет собой заранее

определенную последовательность операций, не требующую вмешательства человека,

и диалог с пользователем отсутствует, информация обрабатывается в так

называемом пакетном режиме. Суть его состоит в том, что программы обработки

данных последовательно выполняются под управлением операционной системы как

совокупность (пакет) заданий. Операционная система обеспечивает ввод данных,

вызов требуемых программ, включение необходимых внешних устройств, координацию

и управление технологическим процессом обработки информации.

Задачи, решаемые в пакетном режиме,

характеризуются следующими свойствами:

• алгоритм решения задачи

формализован, вмешательства пользователя не требуется;

• наличие большого объема

входных и выходных данных, в основном хранящихся на устройствах хранения

информации (например, жестких дисках компьютеров);

• расчет выполняется для

большинства записей входных файлов;

• длительное время решения задачи —

как правило, обусловлено большими объемами обрабатываемых данных;

• регламентность — задачи решаются

с заданной периодичностью.

Пакетный

режим возник первым и широко использовался с середины XX в., когда обработка

информации на ЭВМ осуществлялась в специально создаваемых вычислительных центрах.

Заказчики подготавливали исходные данные (обычно на перфокартах или

перфолентах) и отправляли их в вычислительный центр, где данные обрабатывались

и результаты обработки возвращались заказчику. С развитием персональных ЭВМ

(начиная с 80-х гг. прошлого века) обработка данных стала осуществляться, в

основном, непосредственно потребителями, поэтому в настоящее время пакетный

режим используется достаточно редко. Сегодня более распространен диалоговый

режим, когда необходимо непосредственное взаимодействие пользователя с

компьютером и на каждое свое действие пользователь получает немедленные

ответные действия компьютера. Диалоговый режим позволяет пользователю

интерактивно управлять порядком обработки информации и получать результатные

данные в виде необходимых документов либо файлов.

5.

Технологии передачи и представления информации

Информационные

процессы невозможны без средств передачи и представления информации, поскольку

зачастую информация требуется в месте, территориально удаленном от источника ее

возникновения, и должна быть представлена в виде символов, образов и сигналов,

пригодных для восприятия потребителем.

Современные средства связи способны передавать информацию в любой

форме: телефонные, телевизионные, телеграфные сообщения, массивы данных,

печатные материалы, фотографии и т. д. В соответствии со спецификой

передаваемых сообщений организуется канал передачи информации — совокупность

технических средств, обеспечивающих передачу сигналов от источника к

потребителю.

Основная

характеристика канала передачи — скорость передачи информации, а ее предельно

допустимое значение называют емкостью канала, которая ограничивается шириной

полосы канала и шумом.

Канал связи соединяет передатчик и приемник с помощью линии связи, которая

может быть проводной, кабельной, радио, микроволновой, оптической или

спутниковой. Примерами линий связи являются телефонные и вычислительные сети,

сети телевизионного и радиовещания, мобильной связи, спутниковые технологии

передачи данных.

В современных цифровых системах связи функции передатчика и приемника выполняет

модем. Основное достоинство передачи информации в цифровой форме заключается в

возможности использования кодированных сигналов, обеспечения защиты информации

и наилучшего способа приема.

Для

представления переданной или хранимой информации потребителю используются

процессы воспроизведения и отображения.

Воспроизведение

информации — это процесс, при котором ранее записанная на носителе информация

считывается устройством воспроизведения.

Отображение

информации — есть представление информации, т. е. генерация сигналов на основе

исходных данных, а также правил и алгоритмов их преобразования в форме,

приемлемой для непосредственного восприятия человеком.

Потребителем

информации наиболее часто выступает человек, и для принятия решений ему

необходимы результаты обработки информации. Тем не менее человек не способен

ощутить машинное представление информации, а может воспринимать ее лишь

органами чувств (органами зрения, слуха, осязания, обоняния и т. д.), поэтому

для организации взаимодействия человека с информационными моделями объектов

информационная система должна быть наделена специальными средствами отображения

данных.

Поскольку зрение используется для восприятия информации наиболее активно, то

средства отображения в современных ИС должны представлять информацию в лучшей

форме для визуального наблюдения. Заметим, что мультимедиа-системы позволяют

также представлять информацию в форме аудио- и видеосигналов, однако для

управленческих информационных систем наиболее характерно отображение информации

в текстовой и графической форме, что осуществляется за счет использования

мониторов и печатающих устройств (например, принтеров, плоттеров).

Прежде чем, например, на мониторе, появится информация в доступной

для человека форме, компьютером будет автоматически осуществлена следующая

последовательность операций:

•

преобразование данных, представленных в машинной форме, в вид, приемлемый для

экранного отображения;

• согласование формы представления данных с параметрами монитора;

• воспроизведение в соответствии с возможностями воспроизводящего

устройства (т. е. в данном примере — монитора).

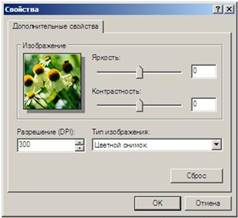

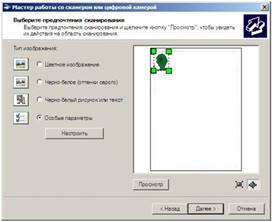

6.Инструкционно-технологическая карта для сканирования фотографий

Перед началом работы положите фотографию на стекло сканера, лицом

вниз. Для того чтобы отсканировать фотографию воспользуйтесь «Мастером работы

со сканером» или используйте программное обеспечение поставляемое

производителем вашего сканера. Мы рассмотрим пример сканирования фотографии

посредством «Мастера работы со сканером».

Для запуска мастера войдите в меню Пуск → Настройки → Панель

управления → Сканеры и камеры → Выберите модель вашего сканера и

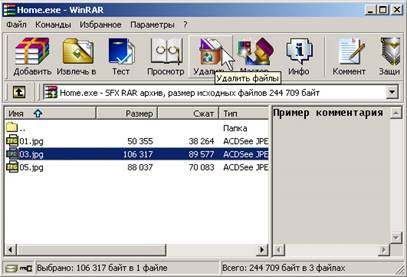

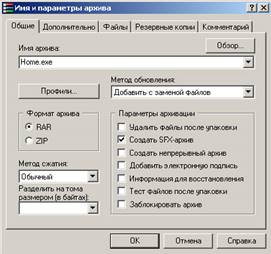

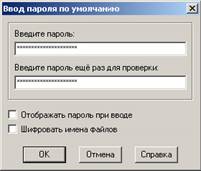

нажмите дважды. В появившемся окне (см. рис.1) выберите «Особые параметры» и

нажмите кнопку «Настроить»

Рисунок

1

Рисунок 2

В появившемся окне (см. рис. 2) выберите «Разрешение (DPI)» — 300, «Тип

изображения» — Цветной снимок и нажмите кнопку ОК, вы попадете в предыдущее

меню в котором необходимо нажать кнопку «Просмотр» (см. рис. 1) У вас на экране

появится предварительный просмотр изображения с вашего сканера (см.рис. 3)

Рисунок

3

Рисунок 4

Для того чтобы отсканировать фотографию правильно необходимо выбрать область

сканирования (выделена пунктирной линией) как показано на рис. 4, в противном

случае сканер кроме фотографии туриста отсканирует также и всю плоскость

стекла, в результате чего в визе туриста вместо фотографии будет напечатан

белый лист, такая визу будет считаться недействительной!

После того как вы выбрали область сканирования нажмите кнопку

«Далее», в появившемся окне укажите название файла, выберите формат файла JPG и

укажите папку для сохранения фотографии, после чего нажмите кнопку «Далее».

Порядок выполнения работы

1. Создание досье

группы. Заранее заготовить материал: фотографии, текст.

2. Сфотографировать

своих однокурсников.

3. Включить компьютер.

4. Создать общую папку

на сервере.

5. Сканировать

фотографии и сохранить в общую папку.

6. Включить текстовый

редактор. Создать титульный лист с общей фотографией и названием группы:

специальность и год.

7. Оформить каждый лист

на одного человека. Записать данные: дата рождения, номер школы, хобби.

8. Сохранить данные на

жесткий диск в свою папку под именем досье группы.

Отчет

Отчет должен быть

оформлен в текстовом редакторе и содержать:

¾

наименование

работы;

¾

цель

работы;

¾

задание;

¾

последовательность

выполнения работы;

¾

ответы

на контрольные вопросы;

¾

вывод

о проделанной работе.

Контрольные вопросы

1. Что такое сбор

информации и каково его предназначение?

2. Что понимается под технологией сбора информации?

3. Чем отличаются понятия «информация» и «данные»?

4. Назовите основные требования к сбору данных и к хранимым

данным.

5. Перечислите основные средства сбора текстовой, графической,

звуковой и видеоинформации. Какие еще средства сбора информации вам известны?

6. Какие еще методы сбора данных вам известны?

7. В чем заключается процедура хранения информации?

8. Перечислите основные требования к структурам хранения.

9. Что такое база данных?

10. В чем различие между базой и банком данных?

11. Что такое резервное копирование и для чего оно

осуществляется?

12. Что такое архивное копирование и в чем его отличие от

резервного копирования?

13. Что такое базовая информационная технология?

14. В чем заключается различие между централизованным и

децентрализованным способами обработки информации?

15. Какие режимы обработки информации вам известны?

Критерии

оценивания практической работы:

5

(отлично) – работа

выполнена полностью и правильно, сделаны правильные выводы; работа выполнена по

плану с учетом техники безопасности.

4 (хорошо) – работа

выполнена правильно с учетом 2-3 несущественных ошибок исправленных

самостоятельно по требованию преподавателя.

3 (удовлетворительно) – работа выполнена правильно не менее чем на половину

или допущена существенная ошибка.

2

(неудовлетворительно) – допущены две (и более) существенные ошибки в ходе

работы, которые студент не может исправить даже по требованию преподавателя.

РАЗДЕЛ 2. ИНФОРМАЦИЯ И ЭНТРОПИЯ

УСТНЫЙ ОПРОС ПО ТЕМЕ

«ТЕОРЕМА ОТСЧЕТОВ»

Вопросы:

- Теорема

отсчетов Котельникова и Найквиста — Шеннона. - Математическая модель системы передачи информации.

Критерии

оценки устного ответа:

«5

(отлично)»: ответ полный и правильный

на основании изученных теорий; материал изложен в определенной логической

последовательности, литературным языком: ответ самостоятельный.

«4

(хорошо)»: ответ полный и правильный

на основании изученных теорий; материал изложен в определенной логической

последовательности, при этом допущены две-три несущественные ошибки,

исправленные по требованию преподавателя.

«3

(удовлетворительно)»: ответ полный,

но при этом допущена существенная ошибка, или неполный, несвязный.

«2

(неудовлетворительно)»: при ответе

обнаружено непонимание студентом основного содержания учебного материала или

допущены существенные ошибки, которые студент не смог исправить при наводящих

вопросах преподавателя.

УСТНЫЙ ОПРОС ПО ТЕМЕ

«ПОНЯТИЕ ЭНТРОПИИ. ВИДЫ ЭНТРОПИИ»

Вопросы:

- Понятие

энтропии. - Формула

Хартли. - Виды

условной энтропии. - Энтропия

объединения двух источников.

Критерии

оценки устного ответа:

«5

(отлично)»: ответ полный и правильный

на основании изученных теорий; материал изложен в определенной логической

последовательности, литературным языком: ответ самостоятельный.

«4

(хорошо)»: ответ полный и правильный

на основании изученных теорий; материал изложен в определенной логической

последовательности, при этом допущены две-три несущественные ошибки,

исправленные по требованию преподавателя.

«3

(удовлетворительно)»: ответ полный,

но при этом допущена существенная ошибка, или неполный, несвязный.

«2

(неудовлетворительно)»: при ответе

обнаружено непонимание студентом основного содержания учебного материала или

допущены существенные ошибки, которые студент не смог исправить при наводящих

вопросах преподавателя.

УСТНЫЙ ОПРОС ПО ТЕМЕ

«СМЫСЛ ЭНТРОПИИ ШЕННОНА»

Вопросы:

1.

Статистический подход к измерению

информации.

2.

Закон аддитивности информации.

3.

Формула Шеннона

Критерии

оценки устного ответа:

«5

(отлично)»: ответ полный и правильный

на основании изученных теорий; материал изложен в определенной логической

последовательности, литературным языком: ответ самостоятельный.

«4

(хорошо)»: ответ полный и правильный

на основании изученных теорий; материал изложен в определенной логической

последовательности, при этом допущены две-три несущественные ошибки,

исправленные по требованию преподавателя.

«3

(удовлетворительно)»: ответ полный,

но при этом допущена существенная ошибка, или неполный, несвязный.

«2

(неудовлетворительно)»: при ответе

обнаружено непонимание студентом основного содержания учебного материала или

допущены существенные ошибки, которые студент не смог исправить при наводящих

вопросах преподавателя.

ПРАКТИЧЕСКАЯ РАБОТА

«ПРИМЕНЕНИЕ ТЕОРЕМЫ ОТЧЕТОВ»

Цель: Изучение возможности синтезирования сигналов по дискретным

отсчетам в соответствии с теоремой Котельникова.

Время

выполнения: 2 часа

Оборудование:

ПК.

Программное

обеспечение: операционная система, калькулятор, текстовый редактор.

Практическое задание

1. Изобразить сигналы:

а)

синусоидальный сигнал частотой 5кГц;

б)

видеоимпульсы прямоугольной формы длительностью 0,25; 0,5; 1,0 мс;

в)

видеоимпульсы пилообразной формы длительностью 0,5 мс; 1,0 мс.

2. Рассчитать и построить

идеальные выборочные сигналы для сигналов, при fвыб=5, 10, 20, 40

кГц.

Отчет

Отчет должен быть оформлен

в текстовом редакторе и содержать:

¾

наименование

работы;

¾

цель

работы;

¾

задание;

¾

последовательность

выполнения работы;

¾

ответы

на контрольные вопросы;

¾

вывод

о проделанной работе.

Контрольные вопросы

1. Сформулируйте теорему

Котельникова для сигналов с ограниченным спектром.

2. Объясните погрешности

синтезирования реальных сигналов по дискретным отсчетам.

Критерии

оценивания практической работы:

5

(отлично) – работа

выполнена полностью и правильно, сделаны правильные выводы; работа выполнена по

плану с учетом техники безопасности.

4 (хорошо) – работа

выполнена правильно с учетом 2-3 несущественных ошибок исправленных

самостоятельно по требованию преподавателя.

3 (удовлетворительно) – работа выполнена правильно не менее чем на половину

или допущена существенная ошибка.

2

(неудовлетворительно) – допущены две (и более) существенные ошибки в ходе

работы, которые студент не может исправить даже по требованию преподавателя.

ПРАКТИЧЕСКАЯ РАБОТА

«ВЫПОЛНЕНИЕ РАСЧЕТОВ ПО

ТЕОРЕМЕ ОТЧЕТОВ. ОПРЕДЕЛЕНИЕ ПРОПУСКНОЙ СПОСОБНОСТИ ДИСКРЕТНОГО КАНАЛА»

Цель: научиться выполнять расчеты по теореме отчетов и определять

пропускную способность дискретного канала.

Оборудование:

ПК.

Программное

обеспечение: операционная система, калькулятор, текстовый редактор.

Теоретические

основы

Пусть

на вход аналогово-цифрового преобразователя поступает гармонический сигнал с

частотой f(период T = 1/f).частоты

исходного сигнала

Проведем

дискретизацию входного аналогового сигнала с периодом дискретизации Tд меньшим половины периода входного

сигнала T (рисунок 1).

Рисунок

1

Очевидно,

что дискретные отсчеты сигнала однозначно не отображают форму исходного

сигнала, в частности по получившимся точкам можно построить гармонический

сигнал с периодом Tискаж.,

отличающимся от периода исходного сигнала T.

Период Tискаж больше периода исходного сигнала T, соответственно частота

меньше, частоты исходного сигнала f (рисунок 2).

Рисунок

2

Данный

эффект называется стробоскопическим эффектом или алиасингом. Он заключается в

появлении ложной низкочастотной составляющей при дискретизации сигнала с

частотой меньшей удвоенной частоты исходного сигнала (или с периодом большим

половины периода исходного сигнала), отсутствующей в исходном сигнале.

Пример 2

Уменьшим

период дискретизации до половины периода исходного аналогового сигнала (частоту

дискретизации увеличим до удвоенной частоты исходного сигнала). В данной

ситуации возникает неопределенность начальной фазы и амплитуды сигнала, при

этом частота исходного сигнала не искажается. В крайнем случае мы можем

получить отсчеты сигнала равные нулю (рисунок 3).

Рисунок

3

Пример 3

Продолжим

уменьшение периода дискретизации. Если период дискретизации меньше половины

периода исходного сигнала, то очевидно, что через получившиеся после оцифровки

точки можно построить только один гармонический сигнал, соотвествующий

исходному, без искажения начальной фазы, амплитуды и частоты (рисунок 4).

Данное утверждение теоретически обосновано и мы его примем без доказательства.

Рисунок

4

Таким

образом, для адекватного восстановления гармонического сигнала по дискретным

отсчетам, частота дискретизации должна быть не меньше половины частоты сигнала.

Частота равная половине частоты дискретизации называется частотой Найквиста fN = fД/2.

Данное

утверждение можно обобщить следующим образом:

Аналоговый

сигнал с ограниченным спектром может быть восстановлен однозначно и без

искажений по своим дискретным отсчетам, взятым с частотой большей удвоенной

максимальной частоты в своем спектре.

fд > 2·Fmax (1)

Данное

утверждение известно как теорема

Котельникова (в западной

литературе теорема

Найквиста-Шеннона) или теорема отсчетов. В различных источниках в

формулировке данной теоремы могут быть различия, основным из которых является

знак сравнения в формуле 1: fд

≥ 2·Fmax или fд > 2·Fmax. Мы

придерживаемся формулировки со знаком строго

больше, так как при

частоте оцифровки равной максимальной частоте в спектре возникают

неоднозначности начальной фазы и амплитуды.

На

практике аналоговый сигнал, как правило, оцифровывают с частотой в несколько

раз превышающей удвоенную частоту в спектре сигнала, хотя существуют методики

оцифровки сигнала с нарушением теоремы отсчетов.

Пропускная

способность непрерывного канала

Пусть сигнал на

выходе канала представляет собой сумму полезного сигнала и шума

, т.е.

, причем

и

статистически

независимы. Допустим, что канал имеет ограниченную полосу пропускания шириной . Тогда в

соответствии с теоремой Котельникова (см. п. 1.5) функции ,

и

можно

представить совокупностями отсчетов ,

, и

,

, где

. При этом

статистические свойства сигнала можно

описать многомерной ПРВ , а свойства

шума – ПРВ .

Пропускная способность непрерывного канала определяется следующим

образом:

|

|

где – количество информации о какой-либо

реализации сигнала длительности T, которое в среднем

содержит реализация сигнала той же длительности

, а максимум ищется по всем возможным

распределениям.

Когда сигнал на входе канала имеет нормальное распределение и

отсчеты независимы величина максимизируется [6]. Поэтому

пропускная способность гауссовского канала с дискретным временем, рассчитанная

на единицу времени, с учетом (4.16) может быть записана в виде

|

|

(4.17) |

Полученное выражение показывает, что пропускная способность

гауссовского канала с дискретным временем определяется числом импульсов,

передаваемых в секунду, и отношением сигнал/шум ().

С учетом взаимосвязи скорости передачи информации и полосы частот

непрерывного канала от (4.17) можно перейти к формуле Шеннона, которая

устанавливает связь пропускной способности гауссовского канала с полосой

пропускания непрерывного канала и отношением мощности сигнала к мощности

помехи:

|

|

(4.18) |

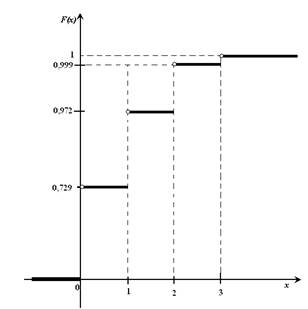

График отношения изображен на рис. 4.6. Заметим,

что при малом отношении

|

|

а пропускная способность канала связи прямо пропорциональна этому

отношению.

При большом отношении в (4.18) можно пренебречь единицей и

считать, что

|

|

т.е. зависимость пропускной способности непрерывного канала от

отношения сигнал/шум логарифмическая.

Пропускная способность канала, как предельное значение скорости

безошибочной передачи информации, является одной из основных характеристик

любого канала.

Определим пропускную способность стандартного канала тональной

частоты, имеющего границы эффективно передаваемых частот кГц, среднюю мощность сигнала на

выходе 56 мкВт при средней мощности помехи 69000 пВт.

Согласно (4.18), при заданных параметрах

|

|

Для непрерывных каналов справедлива теорема Шеннона, согласно

которой сообщения дискретного источника могут быть закодированы и переданы по

непрерывному каналу так, что вероятность ошибочного декодирования принятого

сигнала будет меньше наперед заданной

положительной величины , если производительность источника

меньше пропускной способности

непрерывного канала.

Для типовых непрерывных каналов многоканальной связи основные

технические характеристики и пропускная способность, вычисленная по формуле

Шеннона (4.18), при отношении сигнал/шум 20 дБ, приведены в табл. 4.4.

Зная пропускную способность канала и информационные характеристики

сообщений (табл. 4.5), можно определить, какие сообщения (первичные сигналы)

можно передавать по заданному каналу.

Таблица 4.4. Характеристики типовых

каналов многоканальной связи

|

Наименование канала |

Границы передаваемых частот, Гц |

Пропускная способность, бит/с |

|

Тональной частоты |

300…3400 |

20,64∙103 |

|

Предгрупповой |

12,3∙103…23,4∙103 |

73,91∙103 |

|

Первичный широкополосный |

60,6∙103…107,7∙103 |

313,6∙103 |

|

Вторичный широкополосный |

312,3∙103…551,4∙103 |

1,59∙106 |

|

Третичный широкополосный |

812,3∙103…2043,7∙103 |

8,2∙106 |

Таблица 4.5. Производительность источников

сообщений

|

Вид сообщения |

Характер сообщения |

Параметры АЦП |

Производительность, бит/с |

|

|

|

|

|||

|

Телеграфные, 50 Бод |

дискретные |

– |

– |

30…50 |

|

Телефонные |

непрерывные |

8∙103 |

8 |

64∙103 |

|

Звукового вещания: первого класса |

непрерывные |

24∙103 |

240∙103 |

|

|

высшего класса |

непрерывные |

32∙103 |

13 |

416∙103 |

|

Факсимильные, 120 строк/с: полутоновые |

непрерывные |

2,93∙103 |

4 |

11,72∙103 |

|

штриховые |

дискретные |

– |

– |

2,93∙103 |

|

Передача данных, 2400 Бод |

дискретные |

– |

– |

2,4∙103 |

|

Телевизионные |

непрерывные |

13∙106 |

16 |

208∙106 |

Например, первичный сигнал телевизионного вещания имеет (табл. 4.5) и поэтому не может быть

передан ни по одному из типовых непрерывных или цифровых каналов без потери

качества. Следовательно, для передачи сигнала телевизионного вещания требуется

создание специальных каналов с более высокой пропускной способностью или

снижение скорости цифрового потока.

Задачи

1. Число символов

алфавита m = 4. Вероятности появления символов равны

соответственно p1 = 0,15; p2 = 0,4; p3 =

0,25; p4 = 0,2. Длительности символов t1 =

3с; t2 = 2с; t3 = 5с, t4 = 6с. Чему равна

скорость передачи сообщений, составленных из таких символов?

2. Сообщения составлены из

пяти качественных признаков (m = 5). Длительность элементарной

посылки t = 20мс. Определить, чему равна скорость передачи сигналов и

информации.

3. Определить пропускную

способность бинарного канала связи, способного передавать 100 символов 0 или 1

в единицу времени, причем каждый из символов искажается (заменяется противоположным)

с вероятностью р = 0,01.

4. Имеются источник

информации с энтропией в единицу времени H(Х) = 100 дв.ед. и два канала

связи; каждый из них может передавать в единицу времени 70 двоичных знаков (0

или 1); каждый двоичный знак заменяется противоположным с вероятностью р = 0,1.

Требуется выяснить, достаточна ли пропускная способность этих каналов для

передачи информации, поставляемой источником.

5. Чему равна пропускная

способность симметричного канала, если источник вырабатывает сигналы со

скоростью 2 знака в секунду, закодированные кодом с основанием m =

10, а вероятность ложного приема р = 0,3?

6. Сообщения составлены из

алфавита Х = (х1, x2, x3). Вероятности появления символов

алфавита 0,7; 0,2; 0,1 соответственно. Помехи в канале связи заданы следующей

канальной матрицей:

Определить скорость передачи

информации, если время передачи одного символа t1 = 0,02с.

7. Чему раина пропускная

способность канала связи, описанного канальной матрицей:

если известно, что на выходе

источника сообщений символы вырабатываются со скоростью 100 знаков в секунду?

8. Определить максимально

возможную скорость передачи информации по радиотехническому каналу связи пункта

управления с телеуправляемой ракетой, если полоса пропускания канала связи

равна 3 МГц, а минимальное отношение сигнал-шум по мощности в процессе

наведения ракеты на цель равно 3.

9. Определить полосу

пропускания канала передачи телевизионного черно-белого изображения с

5х105 элементами, 25 кадрами в секунду и 8 равновероятными градациями

яркости для отношения P/N = 15 при условии, что изображение может

принимать наиболее хаотичный вид «белого шума».

Отчет

Отчет должен быть

оформлен в текстовом редакторе и содержать:

¾

наименование

работы;

¾

цель

работы;

¾

задание;

¾

последовательность

выполнения работы;

¾

ответы

на контрольные вопросы;

¾

вывод

о проделанной работе.

Контрольные вопросы

1. Что такое пропускная

способность канала передачи информации? Чем отличается пропускная способность

от скорости передачи информации по каналу связи?

2. Чем отличается

информационная скорость передачи от технической, и в каких единицах эти

скорости измеряются?

3. Как изменяется пропускная

способность дискретного канала связи при воздействии на канал помех.

4. Сформулируйте основную

теорему Шеннона о кодировании для канала без помех.

5. Сформулируйте и поясните

теорему Шеннона о кодировании для канала с помехами.

6. Приведите выражение

пропускной способности для дискретного канала без помех и с помехами.

7. Сформулируйте и поясните

теорему отсчетов (Котельникова)

8. Какие параметры влияют на

объем сигнала.

9. От чего зависит пропускная

способность непрерывного канала связи.

10. Назовите условия

согласования источников информации с пропускной способностью непрерывных

каналов связи.

11. Какова скорость

отображения информации приемным устройством отображения информации.

Критерии

оценивания практической работы:

5

(отлично) – работа

выполнена полностью и правильно, сделаны правильные выводы; работа выполнена по

плану с учетом техники безопасности.

4 (хорошо) – работа

выполнена правильно с учетом 2-3 несущественных ошибок исправленных

самостоятельно по требованию преподавателя.

3 (удовлетворительно) – работа выполнена правильно не менее чем на половину

или допущена существенная ошибка.

2

(неудовлетворительно) – допущены две (и более) существенные ошибки в ходе

работы, которые студент не может исправить даже по требованию преподавателя.

ПРАКТИЧЕСКАЯ РАБОТА

«ПОИСК ЭНТРОПИИ СЛУЧАЙНЫХ ВЕЛИЧИН»

Цель:

научиться вычислять энтропию случайной величины.

Оборудование:

ПК.

Программное

обеспечение: операционная система, калькулятор, текстовый редактор.

Теоретические

основы

Энтропия в теории информации — мера хаотичности информации, неопределённость появления какого-либо символа первичного

алфавита. При отсутствии информационных потерь численно равна количеству

информации на символ передаваемого сообщения.

Так,

возьмём, например, последовательность символов, составляющих какое-либо

предложение на русском языке. Каждый символ появляется с разной частотой,

следовательно, неопределённость появления для некоторых символов больше, чем

для других. Если же учесть, что некоторые сочетания символов встречаются очень

редко, то неопределённость ещё более уменьшается (в этом случае говорят об

энтропии n-ого порядка). Концепции информации и энтропии имеют глубокие связи

друг с другом, но, несмотря на это, разработка теорий в статистической механике

и теории информации заняла много лет, чтобы сделать их соответствующими друг

другу.

Энтропия независимых случайных событий x с n возможными

состояниями (от 1 до n) рассчитывается по формуле:

Эта величина также называется средней

энтропией сообщения. Величина называется частной энтропией,

характеризующей только i-e состояние.

Таким образом, энтропия

события x является суммой с противоположным знаком всех

произведений относительных частот появления события i, умноженных

на их же двоичные логарифмы (основание 2 выбрано только для удобства работы с

информацией, представленной в двоичной форме). Это определение для дискретных